Chaque référenceur le sait : Suivre les évolutions de l’algorithme de Google est devenu un réflexe indispensable. Certaines mises à jour passent presque inaperçues, tandis que d’autres redessinent complètement la visibilité de milliers de sites. Le spam update fait partie de ces changements qui suscitent beaucoup d’attention, car il vise à protéger les internautes en supprimant des résultats de recherche les pratiques jugées abusives. La dernière en date, déployée le 26 août 2025, a une fois de plus rappelé que le moteur ne cesse de perfectionner ses systèmes de détection pour garantir des résultats fiables et utiles. Pour les prestataires du SEO comme pour les éditeurs de sites, ces évolutions sont à double tranchant. Elles peuvent entraîner une perte brutale de trafic et de positions, mais aussi offrir une opportunité de se démarquer si l’on respecte les règles du jeu. Comprendre comment fonctionnent les Google Search Spam Updates, ce qu’elles corrigent et comment s’y préparer est devenu un enjeu majeur pour assurer la pérennité d’une stratégie digitale.

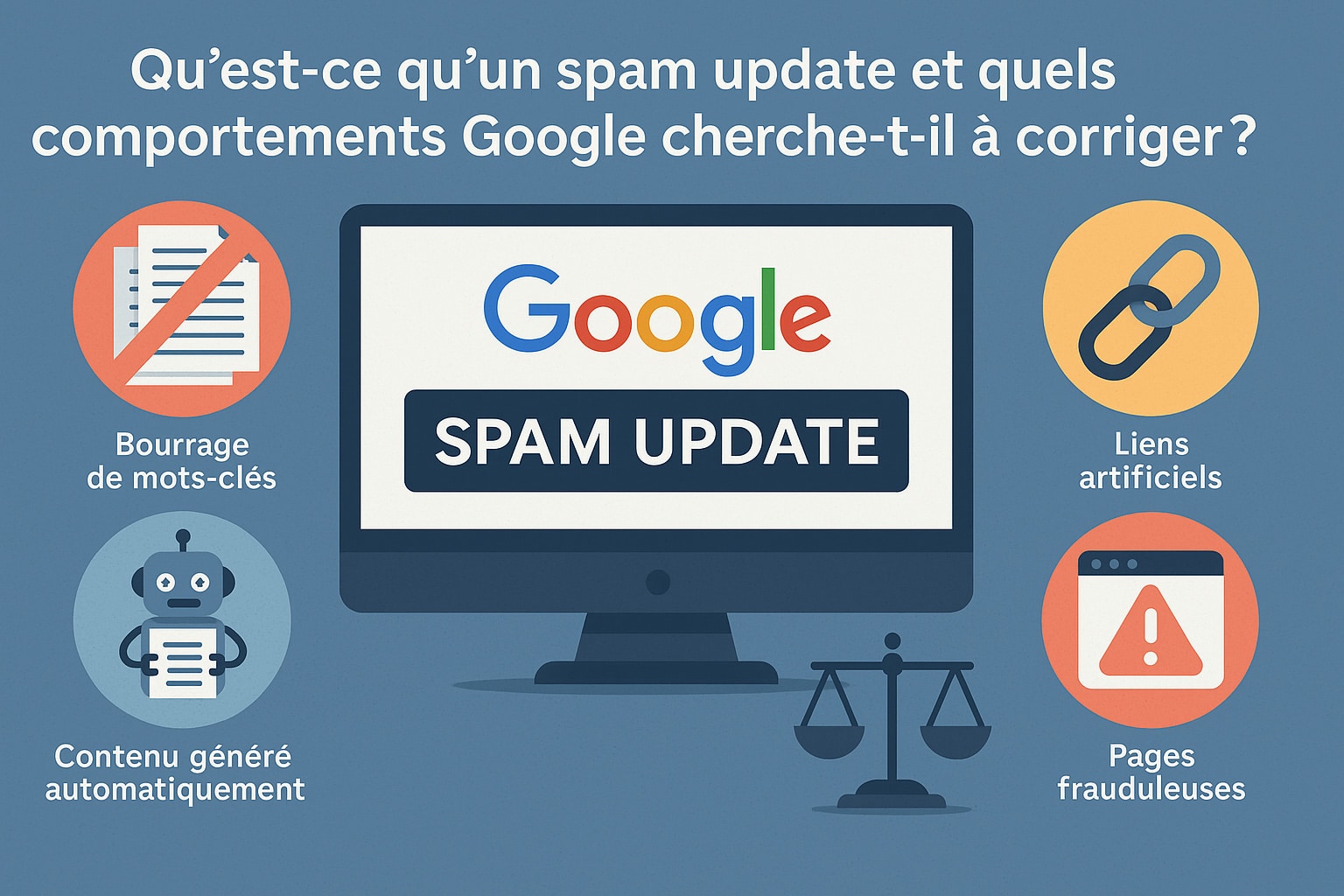

Qu’est-ce qu’un spam update et quels comportements google cherche-t-il à corriger ?

Un spam update est une mise à jour spécifique des systèmes automatisés de Google conçus pour identifier et limiter les techniques de manipulation dans les résultats de recherche. Alors que les algorithmes « classiques » s’appuient sur des critères de pertinence, d’autorité et de qualité de contenu pour classer les pages, les mises à jour anti-spam se concentrent sur un objectif précis : protéger l’internaute contre les pratiques trompeuses et abusives. Historiquement, les premières vagues de spam concernaient surtout des techniques très visibles comme le bourrage de mots-clés ou la duplication massive de pages. Mais avec l’évolution des pratiques SEO, Google a dû perfectionner ses systèmes afin de contrer des manipulations beaucoup plus sophistiquées. Aujourd’hui, un spam update couvre un spectre large d’actions nuisibles, allant du contenu automatisé de faible qualité aux réseaux opaques de backlinks artificiels. Voici quelques exemples de comportements ciblés par ces mises à jour :

- Contenu généré automatiquement : Les textes produits par des outils automatisés ou des IA sans relecture humaine sont particulièrement visés. On les reconnaît souvent à leurs listes à puces répétitives, leurs tableaux sans valeur ajoutée ou leur utilisation maladroite des tirets et ponctuations. Ces contenus ne respectent pas toujours les subtilités de la langue, ce qui les rend peu agréables à lire. Plusieurs sites qui s’appuyaient massivement sur ce type de contenus ont vu leur visibilité chuter après un spam update, preuve que Google sait désormais les détecter plus efficacement ;

- Bourrage de mots-clés (keyword stuffing) : Autrefois utilisé pour « forcer » l’algorithme à considérer une page comme pertinente, ce procédé est aujourd’hui un signal négatif. Les textes deviennent artificiels, perdent en fluidité et en crédibilité aux yeux des lecteurs. Lorsqu’un site abuse de cette méthode, il s’expose à une perte de positions rapide. L’algorithme est de plus en plus sensible aux excès : Un champ lexical riche et naturel est désormais récompensé, alors que la répétition mécanique est pénalisée ;

- Liens artificiels : Les réseaux de backlinks, les articles creux publiés en masse sur des blogs externes ou encore les ancres insérées dans des threads de forum hors sujet constituent autant de signaux de manipulation. Google sait identifier ces schémas et neutraliser les bénéfices qu’ils pouvaient apporter. Dans de nombreux cas, les sites qui avaient progressé grâce à ces liens perdent ensuite brutalement leur visibilité. À noter : les nouveaux sites peuvent parfois échapper temporairement à ces sanctions, mais généralement, après 8 à 12 mois d’analyse, l’algorithme finit par les rattraper ;

- Redirections trompeuses : Envoyer l’utilisateur vers un contenu différent de celui attendu est l’une des pratiques les plus pénalisées. Ces tactiques nuisent directement à l’expérience utilisateur et déclenchent les signaux d’alerte de Google. Il n’est pas rare que des sites qui progressaient trop vite grâce à ce genre de méthodes voient leur courbe SEO s’effondrer, car l’algorithme considère ces comportements comme des tentatives flagrantes de manipulation ;

- Pages malveillantes ou frauduleuses : Au-delà du spam pur, Google lutte aussi contre les sites qui exploitent techniquement ou financièrement leurs visiteurs. Il peut s’agir de faux contenus redirigeant vers des logiciels indésirables, de pages créées uniquement pour collecter des données sensibles ou de tactiques visant à piéger l’utilisateur. Dans ces cas, la sanction est souvent immédiate, avec une désindexation totale ou partielle.

Pour repérer ces comportements, Google s’appuie sur son système intelligent baptisé SpamBrain. Introduit comme une solution IA, il est capable d’identifier des schémas toujours plus subtils, d’apprendre des comportements abusifs émergents et d’évoluer en continu. Chaque nouvelle version de SpamBrain, intégrée à travers les spam updates, améliore sa précision et sa capacité à maintenir un écosystème de recherche propre et utile. Au fil des années, les évolutions des mises à jour anti-spam se sont concentrées sur différents axes :

- 2021–2022 : Période marquée par un renforcement de la lutte contre le link spam. Google a affiné ses systèmes afin d’annuler l’impact des réseaux de backlinks artificiels, souvent issus d’achats ou d’échanges massifs. C’est également durant cette période que SpamBrain a commencé à mieux identifier les schémas de liens non naturels, ce qui a provoqué la chute de nombreux sites ayant bâti leur visibilité uniquement sur des stratégies de netlinking agressives ;

- 2023 : L’accent a été mis sur la détection des contenus générés automatiquement et dupliqués. Beaucoup de sites tentaient d’inonder les SERP avec des textes produits à la chaîne, souvent sans valeur ajoutée pour l’utilisateur. Grâce aux évolutions de SpamBrain, ces pratiques sont désormais beaucoup plus faciles à repérer, entraînant des pertes importantes pour les sites qui misaient sur des volumes massifs de contenus peu qualitatifs ;

- 2024 : Google a élargi son champ d’action en ciblant non seulement le spam pur, mais aussi les expériences trompeuses. Les techniques de cloaking, les redirections abusives ou les pages qui ne livraient pas réellement ce qu’elles promettaient ont été davantage pénalisées. SpamBrain a évolué vers une approche plus « contextuelle », analysant la cohérence entre les intentions de recherche et le contenu réellement proposé aux internautes ;

- 2025 : Les spam updates se sont multipliées et sont devenues plus précises. Avec l’essor de l’IA générative, Google a dû faire face à une vague de contenus produits automatiquement, parfois indétectables pour un œil humain mais sans réelle valeur ajoutée. L’algorithme a donc été renforcé pour reconnaître non seulement la forme du contenu, mais aussi son utilité et sa pertinence. Parallèlement, de nouvelles techniques de manipulation algorithmique, plus sophistiquées, ont été mieux encadrées. Résultat : les sites respectant une approche centrée sur l’utilisateur sont mieux valorisés, tandis que ceux qui abusent des failles techniques sont de plus en plus rapidement sanctionnés.

Ces évolutions montrent que Google n’agit pas de façon ponctuelle, mais dans une logique d’adaptation constante. Chaque spam update de Google vise à fermer une porte laissée ouverte par les stratégies abusives, pour que seuls les sites apportant une véritable valeur aux utilisateurs puissent bénéficier d’une bonne visibilité.

Comment un spam update peut-il affecter la visibilité de votre site ?

Les impacts d’un spam update peuvent être particulièrement marquants pour les sites concernés. Un site qui repose sur des pratiques non conformes, même de façon partielle, peut voir sa visibilité s’effondrer du jour au lendemain. Cette perte brutale est d’autant plus déstabilisante qu’elle ne s’accompagne généralement pas de notification directe : L’algorithme sanctionne en silence, et seuls les indicateurs de trafic et de positionnement révèlent l’ampleur du problème. Concrètement, les effets peuvent prendre plusieurs formes :

- Une baisse des positions : Les mots-clés stratégiques perdent en visibilité, parfois jusqu’à disparaître de la première page. Dans certains cas, un site peut chuter de plusieurs dizaines de places en quelques heures, ce qui représente une perte de trafic organique considérable ;

- Une perte de trafic organique : La chute de visibilité entraîne mécaniquement une diminution du nombre de visiteurs issus de Google. Pour certains sites très dépendants de leur trafic organique SEO, cela peut avoir un impact direct sur le chiffre d’affaires, les conversions ou la notoriété ;

- Un déclassement temporaire : Il arrive qu’un site soit rétrogradé de manière provisoire. Si les pratiques problématiques sont corrigées rapidement, l’algorithme peut reconsidérer la situation au bout de quelques semaines ou quelques mois. La patience est cependant de mise, car Google attend souvent d’avoir accumulé suffisamment de signaux positifs avant de réévaluer ;

- Dans les cas les plus sévères : Un site peut être en partie ou totalement exclu de l’index. Cela signifie qu’il n’apparaît plus du tout dans les résultats, ce qui équivaut à une invisibilité complète sur Google. Les cas de désindexation touchent surtout les sites qui utilisent massivement des techniques frauduleuses ou qui présentent des risques pour les utilisateurs (contenus trompeurs, malveillants ou dangereux).

Il est essentiel de comprendre que tous les changements ne sont pas forcément négatifs. En effet, chaque spam update agit comme un rééquilibrage de l’écosystème de recherche. Ainsi, un site qui respecte scrupuleusement les bonnes pratiques peut bénéficier d’un « effet d’aubaine » : si ses concurrents sont pénalisés, lui peut mécaniquement voir ses positions progresser. Autrement dit, chaque vague de nettoyage est aussi une opportunité pour les sites qualitatifs de se démarquer et de gagner en crédibilité.

Un cas particulier mérite d’être détaillé : Celui des link spam updates. Lorsqu’ils sont déployés, l’algorithme supprime simplement l’influence des backlinks artificiels. Autrement dit, si un site avait grimpé grâce à un réseau de liens achetés, l’avantage est annulé et le site retombe à sa position « réelle », celle qu’il aurait eue sans ces liens. Contrairement à d’autres sanctions, ce type de perte est irréversible : même si le site supprime ses anciens backlinks douteux et adopte une stratégie plus saine, les bénéfices passés ne reviendront pas. Le message est clair : bâtir un profil de liens naturel et durable est la seule option viable à long terme.

Il faut également noter que l’impact d’un spam update peut varier selon l’ancienneté d’un site. Les sites très récents échappent parfois temporairement aux sanctions, car Google a besoin de plusieurs mois (souvent entre 8 et 12) pour collecter suffisamment de données avant d’appliquer une évaluation fiable. Cela explique pourquoi certains projets semblent progresser rapidement sans respecter toutes les règles, avant de subir un recul brutal lorsque l’algorithme dispose enfin de suffisamment d’éléments. À l’inverse, des sites plus anciens qui connaissent une croissance anormalement rapide peuvent déclencher des signaux d’alerte et être sanctionnés plus tôt.

0 commentaires