Imaginez une équipe qui jongle au quotidien entre fichiers Excel, e-mails et outils SaaS mal adaptés. Les données se perdent, les validations s’enlisent et chaque nouvelle contrainte réglementaire devient un casse-tête. Une application métier sur mesure naît précisément de ce besoin d’aligner l’outil avec le réel : vos processus, vos règles de gestion, vos contraintes de sécurité et vos objectifs. Ici, on ne tord pas l’organisation pour rentrer dans un logiciel générique ; on conçoit un logiciel qui épouse votre façon de travailler, tout en l’optimisant.

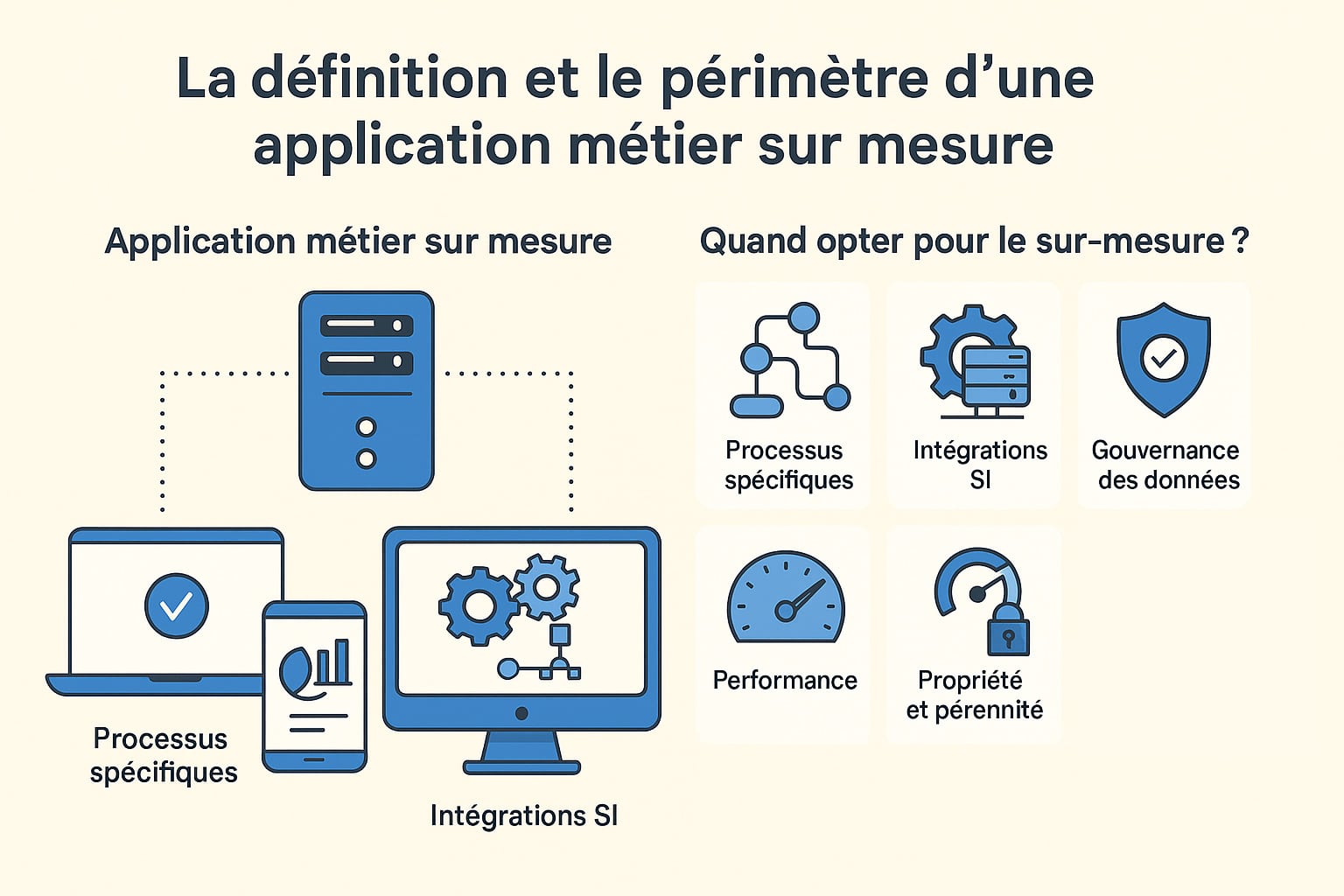

La définition et le périmètre d’une application métier sur mesure

Une application métier sur mesure est un logiciel conçu spécifiquement pour un domaine d’activité, une équipe ou un processus donné. Elle s’appuie sur vos exigences fonctionnelles (workflows, rôles, droits, KPI) et vos contraintes (réglementaires, sécurité, intégration SI), pour livrer juste ce qu’il faut : ni trop, ni pas assez. Elle peut prendre la forme d’une application web, mobile, desktop, ou d’un ensemble de services intégrés.

Quand opter pour le sur-mesure pour une application métier ?

Le recours à une application métier sur mesure s’impose souvent lorsque les processus internes d’une entreprise sont véritablement différenciants. Certaines organisations possèdent un savoir-faire qui ne peut pas être traduit par de simples formulaires ou des modules standards d’un logiciel SaaS. Leurs règles de gestion sont complexes, parfois évolutives, et nécessitent un haut degré de personnalisation. Dans ce contexte, un logiciel générique devient vite un frein à l’efficacité, alors qu’une solution développée sur mesure épouse les particularités métiers et accompagne la croissance sans contraindre les équipes à se conformer à des cadres rigides. Un autre facteur déterminant réside dans la nécessité d’intégrations spécifiques. Les systèmes d’information modernes sont rarement isolés : Ils doivent dialoguer avec des ERP pour la gestion des ressources, des CRM pour la relation client, des MES ou WMS pour la production et la logistique, ou encore des API sectorielles pour se connecter à des partenaires externes. Une application sur mesure offre cette souplesse, car elle est pensée dès le départ pour s’inscrire dans un écosystème existant, en évitant les silos et en fluidifiant les échanges de données.

La gouvernance des données est également une motivation forte. Dans de nombreux secteurs, la traçabilité et l’historisation des informations sont obligatoires, qu’il s’agisse de conformité réglementaire (RGPD, normes qualité, obligations légales) ou de besoins stratégiques. Une application métier sur mesure permet de définir précisément les règles de conservation, de gérer les consentements des utilisateurs et de contrôler les accès avec un niveau de granularité souvent impossible dans un logiciel générique. Cela garantit à la fois sécurité, conformité et transparence. Les exigences de performance et de disponibilité constituent une autre raison d’investir dans une solution personnalisée. Certaines entreprises doivent gérer des pics de charge importants, par exemple lors de périodes de forte activité commerciale ou de lancement de nouveaux produits. D’autres ont besoin que leurs utilisateurs sur le terrain puissent accéder aux données en mobilité, parfois même sans connexion internet, grâce à des fonctionnalités offline-first avec synchronisation différée. Une application sur mesure peut être conçue pour répondre à ces contraintes spécifiques, là où une solution standard montre ses limites.

Enfin, la question de la pérennité et de la propriété est centrale. Opter pour un logiciel sur mesure, c’est s’assurer de garder la maîtrise de la roadmap et du budget d’évolution. Contrairement aux solutions propriétaires ou SaaS, où l’éditeur décide des mises à jour et des orientations stratégiques, une application développée spécifiquement pour l’entreprise reste sa propriété intellectuelle. Elle peut évoluer au rythme des besoins internes, sans dépendre d’acteurs tiers, et devient un véritable actif stratégique, gage d’autonomie et de durabilité.

Du besoin métier à la solution : Un cycle de vie maîtrisé

- Discovery / cadrage : ateliers ux, cartographie de processus, priorisation (moSCoW, rice), définition des indicateurs de succès ;

- Conception : domain-driven design (ddd), user stories, maquettes, modèles de données, règles de gestion explicites ;

- Implémentation : développement incrémental (sprints), revues de code, tests automatisés ;

- Déploiement : intégration et livraison continues (ci/cd), observabilité (logs, métriques, traces), monitoring de la performance ;

- Exploitation et tma : support, correctifs, évolution fonctionnelle, pilotage par la donnée (tableaux de bord).

| besoin métier | exemples de fonctionnalités |

|---|---|

| Gestion d’opérations terrain | Application mobile offline, géolocalisation, checklists, signature, synchronisation différée |

| Pilotage commercial | Pipeline, devis, approbations multi-niveaux, génération de documents, e-signature |

| Qualité et conformité | Workflows auditables, journal d’événements, traçabilité, archivage légal |

| Production/logistique | Ordonnancement, suivi d’atelier, codes-barres/rfid, inventaires, alertes |

L’un des piliers trop souvent négligés est l’arborescence sémantique de l’application (noms d’entités, relations, hiérarchie des écrans et des actions). Inspirée du ddd, elle évite les ambiguïtés, réduit les erreurs d’utilisation et facilite la maintenance. Couplée à un design system cohérent (tokens, composants, règles d’accessibilité wcag/rgaa), elle accélère les développements et garantit l’homogénéité de l’expérience.

Les technologies employées et les architectures possibles pour une application métier

Le choix technologique dépend du contexte : volumétrie, exigences de sécurité, équipe en place, time-to-market, interopérabilité. Il n’existe pas de “stack magique”, mais des assemblages cohérents. Voici un panorama concret et opérationnel.

Le front-end web et mobile de l’application métier

Le front-end constitue la partie visible et manipulable de l’application métier, celle avec laquelle les utilisateurs interagissent au quotidien. Son rôle est déterminant : il ne s’agit pas seulement de proposer une interface agréable, mais également de garantir une expérience fluide, performante et adaptée à chaque contexte d’usage (bureau, mobilité, écran tactile, etc.). Le choix des technologies front-end doit donc répondre à des exigences de réactivité, de scalabilité, de maintenabilité et d’accessibilité.

Pour les interfaces web, les frameworks modernes tels que React, Vue.js ou Angular dominent largement le marché grâce à leur maturité, leur communauté et la richesse de leur écosystème. Certains acteurs, notamment dans des contextes spécifiques ou plus orientés RAD (Rapid Application Development), utilisent également des solutions comme WinDev Mobile ou d’autres assembleurs visuels. Ces approches, bien que moins répandues à l’international, restent adaptées à certains environnements où la rapidité de prototypage prime sur la scalabilité.

Ces frameworks modernes permettent de concevoir des applications dynamiques, modulaires et testables, avec une architecture claire qui facilite les évolutions futures et la maintenance. Ils s’appuient sur un écosystème d’outillage riche : bundlers comme Vite ou Webpack, typage robuste avec TypeScript, gestion d’état avancée avec Redux, Pinia ou Ngrx. Côté qualité logicielle, les suites de tests comme Jest, Testing Library, Cypress ou Playwright permettent d’automatiser les validations fonctionnelles et d’assurer la stabilité du code dans la durée. Enfin, le déploiement est de plus en plus intégré aux workflows de développement grâce à des outils de CI/CD comme GitHub Actions, GitLab CI, Vercel ou Netlify, qui facilitent la mise en production rapide et sécurisée des interfaces.

Lorsqu’une application métier doit également proposer du contenu public (extranets, portails clients, catalogues en ligne), le rendu côté serveur (SSR) ou la génération statique (SSG) deviennent des atouts. Des frameworks comme Next.js (React) ou Nuxt (Vue.js) offrent cette capacité, améliorant la rapidité de chargement initial et le référencement interne. À l’inverse, pour une application strictement interne, où le SEO n’est pas un enjeu, le Client-Side Rendering (CSR) reste largement suffisant et plus simple à mettre en place.

Sur le plan mobile, le choix technologique dépend des contraintes de performance et d’usage. Les développements natifs (avec SwiftUI pour iOS et Kotlin pour Android) restent la référence lorsqu’il s’agit d’exploiter intensivement les capteurs matériels, d’optimiser chaque milliseconde de performance ou de gérer des fonctionnalités avancées (réalité augmentée, traitement vidéo en temps réel, etc.). En revanche, pour mutualiser les efforts et accélérer le time-to-market, des frameworks cross-platform comme React Native ou Flutter permettent de développer un seul code base déployable sur plusieurs environnements, tout en conservant une excellente expérience utilisateur.

L’accessibilité (tout autant que l’UI design de l’application métier) est une dimension incontournable, en particulier pour les organisations soumises aux normes WCAG ou RGAA. Le front-end doit intégrer des composants accessibles (navigation clavier, lecteurs d’écran, contrastes respectés), et ce dès la conception. Les performances ne doivent pas être négligées : Le lazy loading (chargement différé des ressources), le code splitting (découpage du code en modules optimisés) et le suivi des Core Web Vitals (LCP, CLS, INP) garantissent une expérience rapide et stable, sur desktop comme sur mobile.

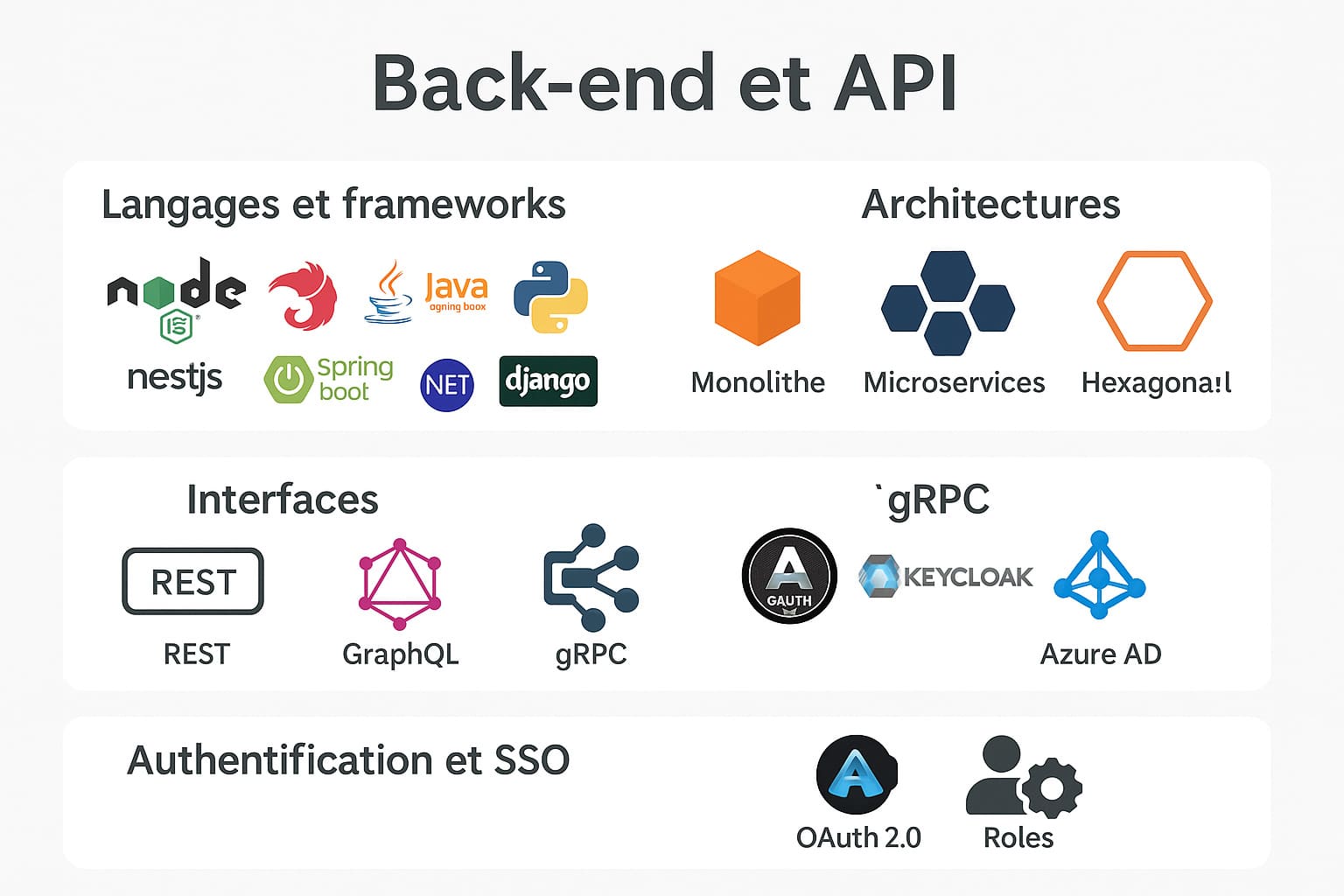

Back-end et API

Le back-end constitue le cœur de l’application métier : C’est lui qui gère les règles de gestion, la persistance des données et la communication avec les autres systèmes. Le choix des langages et frameworks dépend largement des compétences internes et des contraintes du projet. Parmi les écosystèmes les plus courants, on retrouve Node.js (avec NestJS ou Express) pour sa rapidité et son écosystème JavaScript unifié, Java (Spring Boot) pour sa robustesse et sa scalabilité éprouvée, .NET Core (ASP.NET Core) pour les environnements Microsoft, et Python (FastAPI, Django) apprécié pour sa simplicité et sa rapidité de prototypage. Ces frameworks offrent des composants matures couvrant la sécurité, la gestion des tâches asynchrones, le cache ou encore l’intégration avec des bases de données relationnelles et NoSQL.

En termes d’architecture, plusieurs approches sont possibles pour le développement backend. Le monolithe modulaire reste pertinent pour un démarrage rapide et un périmètre fonctionnel limité, car il permet de contenir la complexité et d’accélérer la mise en production. Lorsque les domaines métier sont bien découpés et que les équipes sont autonomes, on peut envisager une architecture en microservices, favorisant l’évolutivité et la résilience. Enfin, des principes tels que l’architecture hexagonale ou la clean architecture permettent d’isoler la logique métier des couches techniques, ce qui facilite la maintenance, les tests et les évolutions sur le long terme.

Les interfaces exposées jouent un rôle central dans la communication avec le front-end et les systèmes tiers. Les API REST dominent toujours par leur simplicité et la richesse de l’outillage (Swagger, Postman). Le GraphQL s’impose lorsqu’il faut agréger des données complexes et offrir plus de flexibilité aux clients (idéal pour les applications front riches). Pour des échanges interservices rapides et fortement typés, notamment dans des environnements distribués, gRPC constitue une option performante et sécurisée.

L’authentification et la gestion des accès sont des enjeux critiques. Les standards comme OAuth2 et OpenID Connect garantissent l’interopérabilité et la sécurité. Des solutions comme Keycloak ou Azure AD permettent de mettre en place du SSO (Single Sign-On) et d’assurer une expérience utilisateur fluide entre plusieurs applications. Le contrôle des droits peut reposer sur des modèles RBAC (Role-Based Access Control) ou ABAC (Attribute-Based Access Control), selon le niveau de granularité attendu. La traçabilité est assurée par des journaux d’audit centralisés, indispensables pour répondre aux exigences de conformité et détecter les anomalies.

Enfin, un back-end moderne doit intégrer des mécanismes de scalabilité et de résilience. Cela passe par l’usage de caches (Redis, Memcached), de files de messages (RabbitMQ, Kafka), et d’outils d’observabilité (logs, métriques, traces distribuées). La documentation de l’API via Swagger/OpenAPI ou GraphQL Playground est également un point clé, car elle facilite l’adoption de l’application par les équipes internes comme par des partenaires tiers.

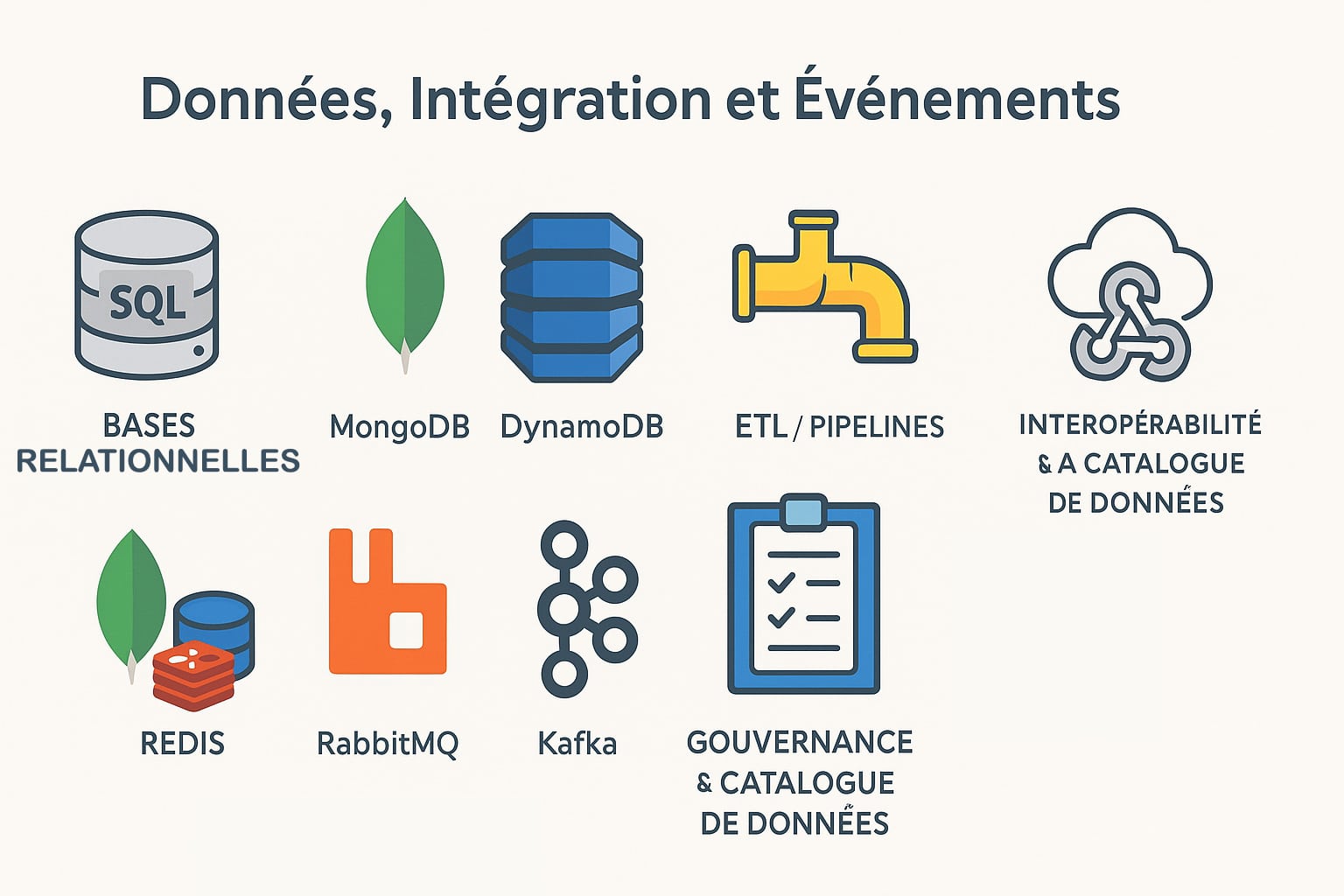

Données, intégration et événements de l’application métier

La gestion des données est un pilier central dans toute application métier sur mesure, car elle conditionne à la fois la fiabilité des processus, la qualité de l’information et la capacité à interagir avec d’autres systèmes. Le choix des technologies dépend des besoins en cohérence, en volume, en rapidité et en flexibilité.

Les bases de données relationnelles telles que PostgreSQL, MySQL/MariaDB ou SQL Server demeurent la solution privilégiée lorsqu’il s’agit de garantir la cohérence transactionnelle (ACID). Elles permettent de gérer des schémas complexes avec relations, de mettre en place des vues matérialisées pour accélérer certaines requêtes, ou encore de tirer parti de fonctions stockées pour encapsuler des règles métier. Grâce à leurs mécanismes de réplication et de haute disponibilité, elles assurent la résilience et la continuité de service attendues dans un environnement critique.

Pour des besoins plus spécifiques, les bases non relationnelles viennent compléter ce socle. MongoDB et DynamoDB répondent particulièrement bien aux besoins de flexibilité des schémas et de stockage de gros volumes de données semi-structurées. Redis, quant à lui, est largement utilisé comme cache en mémoire, pour la gestion de sessions ou encore comme file d’attente légère, garantissant des temps de réponse extrêmement faibles sur des parcours sensibles (authentification, recherche, transactions rapides).

La messagerie et le streaming occupent une place croissante dans les architectures modernes. Des solutions comme RabbitMQ assurent une communication asynchrone fiable entre services, en garantissant la livraison des messages. À plus grande échelle, Kafka permet de bâtir une infrastructure orientée événements, adaptée aux cas d’usage de temps réel, de traçabilité fine et de gestion d’historiques volumineux. Ces approches favorisent la scalabilité et l’auditabilité, en offrant une vision claire des flux métiers.

Enfin, l’intégration et la transformation des données s’appuient de plus en plus sur des outils modernes de type ETL/ELT. Apache Airflow ou dbt facilitent l’orchestration et la transformation de données en pipelines reproductibles et traçables. L’interopérabilité est assurée via des webhooks, des systèmes de files de messages, ou encore des ESB (Enterprise Service Bus) légers qui orchestrent les échanges entre applications. La mise en place de schémas versionnés et de catalogues de données devient incontournable pour garantir une gouvernance claire et réduire les erreurs liées aux évolutions du modèle.

En combinant bases relationnelles et non relationnelles, mécanismes d’événements et pipelines d’intégration, une application métier peut ainsi s’adapter aux exigences d’aujourd’hui : rapidité, fiabilité, interopérabilité et conformité. La clé réside dans une conception où chaque choix technique sert directement les besoins métiers, sans surdimensionner l’architecture, mais en prévoyant sa capacité d’évolution.

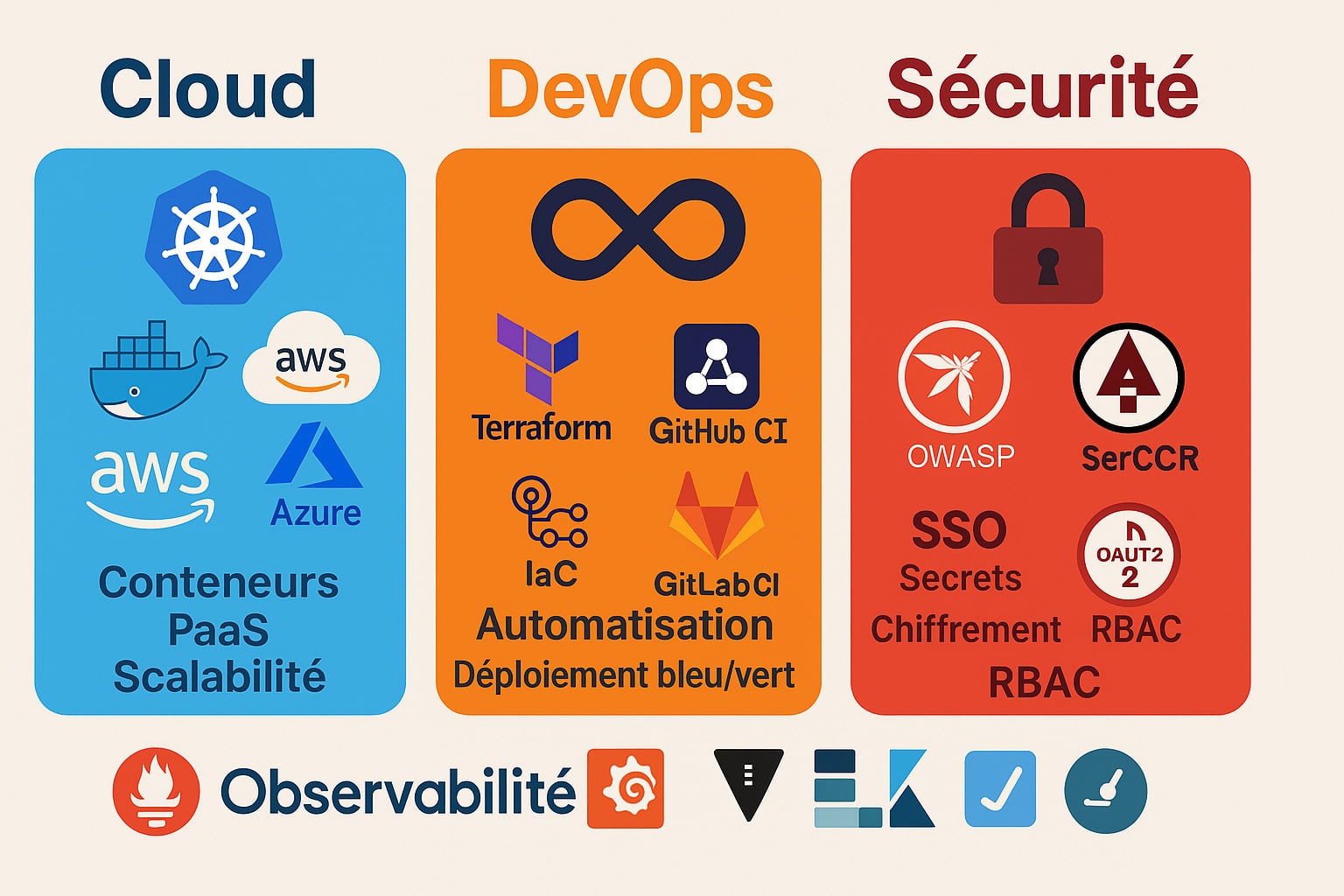

Cloud, DevOps et sécurité de l’application métier sur mesure

Le déploiement et l’exploitation d’une application métier sur mesure reposent sur un socle Cloud et DevOps solide. L’objectif est de garantir une scalabilité maîtrisée, une mise en production fiable et une sécurité intégrée dès la conception. Chaque couche de la chaîne logicielle est concernée, depuis l’infrastructure jusqu’au monitoring et à la gestion des menaces :

- Infrastructure : Les conteneurs sont devenus la norme pour packager et distribuer les applications. Docker permet de standardiser l’environnement d’exécution, tandis que Kubernetes orchestre le déploiement à grande échelle, en assurant haute disponibilité et autoscaling. Pour les entreprises souhaitant réduire la complexité d’exploitation, les PaaS comme AWS Elastic Beanstalk, Azure App Service ou Google Cloud Run offrent une alternative plus managée, tout en restant évolutifs ;

- Infrastructure as Code (IaC) et CI/CD : La gestion d’infrastructure via des outils comme Terraform ou Pulumi assure une traçabilité et une reproductibilité des environnements. Côté automatisation, les pipelines CI/CD via GitHub Actions, GitLab CI ou Azure DevOps intègrent des étapes systématiques : linting, exécution des tests unitaires et fonctionnels, scans de sécurité, puis déploiement bleu/vert ou canary afin de limiter les risques lors des mises à jour ;

- Observabilité : Une application métier doit être suivie en continu, aussi bien pour sa performance que pour sa fiabilité. Les métriques sont collectées avec Prometheus et visualisées dans Grafana, tandis que les logs sont centralisés via Loki ou une stack ELK (Elasticsearch, Logstash, Kibana). Les traces distribuées (via OpenTelemetry) permettent de diagnostiquer les problèmes de latence dans des architectures complexes. Des systèmes d’alerting reliés à un service d’astreinte garantissent une réaction rapide en cas d’incident ;

- Sécurité : La sécurité applicative ne peut pas être ajoutée après coup, elle doit être intégrée dès la conception (security by design). Cela implique la gestion centralisée des secrets (Vault, AWS Secret Manager), l’exécution régulière de scans de dépendances (SAST/DAST), le durcissement des en-têtes HTTP, ainsi que le chiffrement des données au repos et en transit. Les recommandations issues de l’OWASP Top 10 sont utilisées comme base pour prévenir les vulnérabilités les plus courantes. Côté identité, la mise en place d’un SSO basé sur OAuth2/OIDC (Keycloak, Azure AD) assure une gestion fine des accès (RBAC/ABAC) et une traçabilité grâce aux journaux d’audit.

Ainsi, le triptyque Cloud – DevOps – Sécurité forme la colonne vertébrale de l’application métier. Une gouvernance claire, des pipelines automatisés et une vigilance constante en matière de sécurité permettent de concilier agilité et robustesse.

| Composant | Technologies usuelles |

|---|---|

| UI Web | React, Vue.js, Angular, TypeScript, Design System |

| API | NestJS, Spring Boot, ASP.NET Core, FastAPI, REST/GraphQL/gRPC |

| Données | PostgreSQL, MySQL, SQL Server, MongoDB, Redis |

| Intégrations | Webhooks, RabbitMQ, Kafka, ETL/ELT |

| DevOps | Docker, Kubernetes, Terraform, GitHub Actions/GitLab CI |

| Observabilité | Prometheus, Grafana, ELK/Loki, Uptime checks |

| Sécurité / Identité | OAuth2/OIDC, Keycloak, Azure AD, Vault, scanners de dépendances |

La qualité logicielle et la gouvernance de l’application métier

La réussite d’une application métier sur mesure ne repose pas uniquement sur la technologie choisie ou l’ergonomie des interfaces. Elle dépend également de la qualité logicielle et de la gouvernance du projet, qui assurent la fiabilité, la maintenabilité et l’évolution de l’outil sur le long terme :

- Les tests automatisés sont un pilier incontournable pour sécuriser le code et éviter les régressions. Les tests unitaires (via Jest, JUnit, xUnit) valident le bon fonctionnement des briques isolées du système. Les tests d’intégration, parfois appuyés par Testcontainers, garantissent la cohérence entre modules, notamment lorsqu’ils communiquent avec des bases de données ou des services externes. Enfin, les tests de bout en bout (E2E) exécutés avec Cypress ou Playwright simulent les scénarios utilisateurs réels et valident la fluidité des parcours critiques. La couverture doit être concentrée sur les domaines métier sensibles (paiement, conformité, reporting), avec des jeux de données réalistes et des environnements de préproduction proches de la production ;

- La documentation constitue un autre volet essentiel. Pour les API, l’usage d’OpenAPI/Swagger permet de générer automatiquement une documentation technique lisible et exploitable par les équipes de développement tierces. Les schémas de données doivent être versionnés pour suivre l’évolution du modèle, et des runbooks détaillés doivent être rédigés afin de faciliter l’exploitation quotidienne (procédures de redémarrage, gestion des incidents, bonnes pratiques de monitoring) ;

- L’accessibilité et l’internationalisation (i18n) doivent être intégrées dès la conception. Le respect des référentiels RGAA et WCAG assure l’accessibilité aux personnes en situation de handicap, et constitue aussi un gage de qualité universelle. Côté internationalisation, il est important de prévoir la gestion des traductions, des formats locaux (monnaie, dates, unités), ainsi que la prise en charge des fuseaux horaires pour garantir une expérience cohérente dans un contexte multiculturel ou multisite ;

- La gouvernance du projet s’organise autour d’un backlog priorisé, d’une roadmap claire (souvent établie par trimestre) et d’un pilotage budgétaire adapté. Les activités de TMA (Tierce Maintenance Applicative) doivent couvrir la correction des anomalies, mais aussi les évolutions fonctionnelles en fonction des besoins métiers. La réussite se mesure à travers des indicateurs tangibles : taux d’adoption par les utilisateurs, temps opérationnel gagné, réduction du nombre d’erreurs, amélioration du MTTR (Mean Time To Repair) en cas d’incident.

Un sujet transversal mérite une attention particulière : l’adaptation du discours aux interlocuteurs. La technicité d’une recommandation doit être traduite différemment selon l’audience. Un CEO attend des arguments orientés ROI et performance globale, un responsable métier souhaite comprendre les impacts opérationnels, un développeur se concentre sur l’implémentation technique, tandis qu’un DPO s’intéressera à la conformité et à la gouvernance des données. Utiliser un vocabulaire adapté, expliciter les termes complexes et fournir des exemples concrets facilite l’alignement. Par exemple, plutôt que de parler uniquement de “réduire la profondeur de clic”, il est plus clair d’expliquer : “rendre les écrans clés accessibles en moins de 3 interactions”. De tels critères d’acceptation concrets accélèrent la mise en œuvre et réduisent les malentendus entre équipes.

En combinant qualité logicielle, documentation claire, accessibilité, gouvernance agile et communication adaptée, une application métier sur mesure devient un véritable levier de performance durable, capable d’évoluer avec les besoins de l’organisation tout en conservant sa robustesse.

0 commentaires