Poser une seule question à Google, même complexe, et recevoir une réponse riche, nuancée, qui anticipe les besoins sans nécessiter de multiples reformulations devient désormais possible. C’est la promesse de Google MUM, pour Multitask Unified Model. Présentée en mai 2021 comme une avancée majeure dans l’intelligence artificielle appliquée à la recherche, cette technologie ambitionne de transformer en profondeur notre manière d’interagir avec le moteur de recherche. Grâce à une compréhension approfondie du langage, des images et d’autres formats de contenu, MUM offre des réponses plus pertinentes, mieux contextualisées et accessibles à travers de nombreuses langues. Voici un tour d’horizon de son fonctionnement, de ses spécificités et de son impact potentiel sur les pratiques de recherche et de référencement.

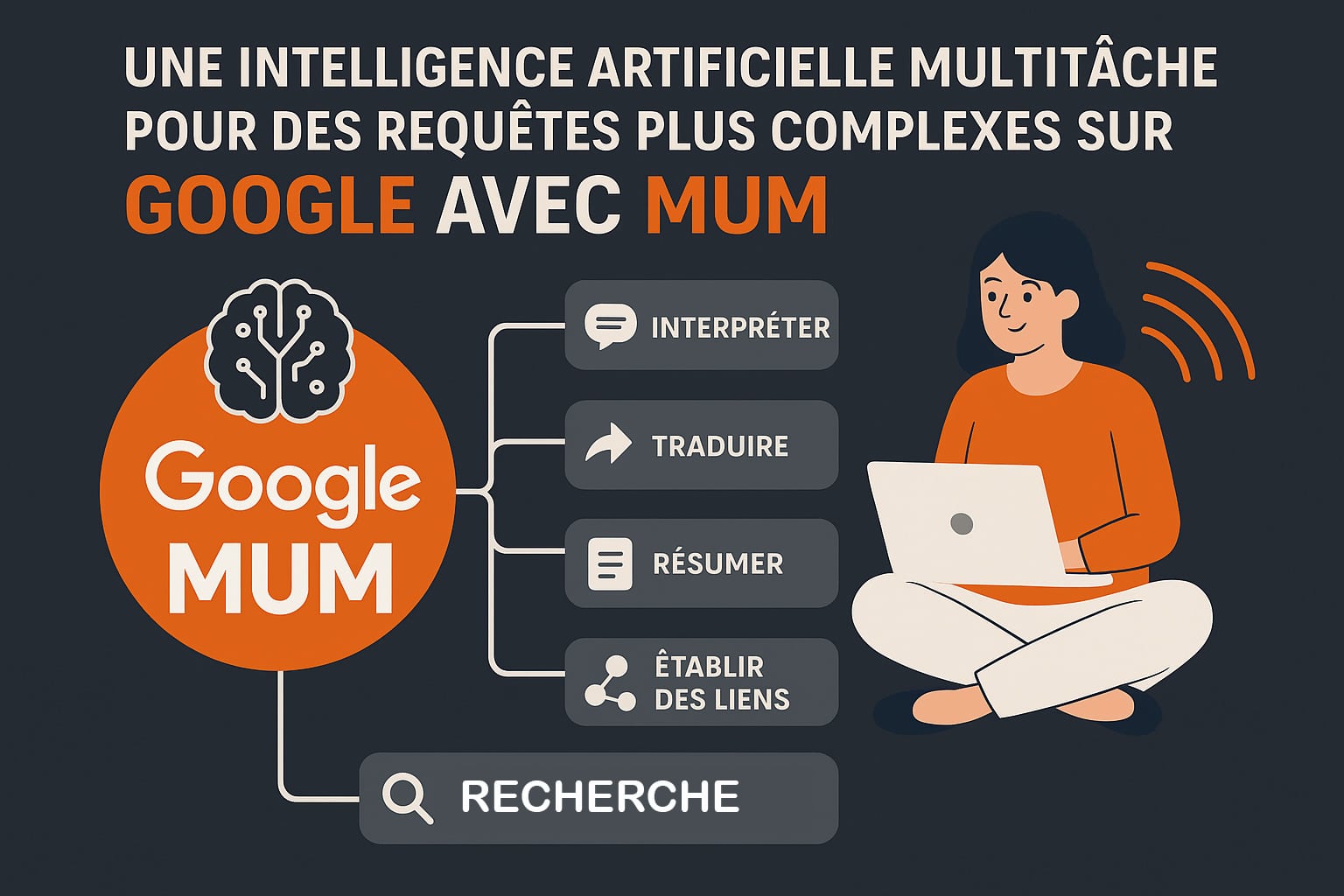

Une intelligence artificielle multitâche pour des requêtes plus complexes sur Google avec MUM

L’histoire de l’intelligence artificielle chez Google est jalonnée d’innovations destinées à rendre la recherche en ligne plus naturelle, plus rapide et surtout, plus pertinente. Tout commence véritablement en 2018 avec l’iintroduction de BERT (Bidirectional Encoder Representations from Transformers), un modèle de langage fondé sur l’architecture Transformer. Développé par les chercheurs de Google AI à Mountain View, en Californie, BERT représentait une avancée significative : pour la première fois, un algorithme était capable de comprendre le contexte d’un mot en analysant les mots qui l’entourent, dans les deux sens d’une phrase. Cela a permis à Google de mieux interpréter les requêtes en langage naturel et de répondre plus justement aux intentions de recherche. Mais très vite, les ingénieurs ont identifié les limites de ce modèle, notamment lorsqu’il s’agissait de requêtes complexes, souvent composées de plusieurs sous-questions ou reposant sur des comparaisons implicites. En réponse à cette problématique, Google a dévoilé en mai 2021, lors de sa conférence annuelle Google I/O, un nouveau jalon dans le développement de l’intelligence artificielle : Google MUM, acronyme de Multitask Unified Model.

Conçu sous la direction de Pandu Nayak, vice-président de la recherche chez Google et chercheur senior dans le domaine du traitement automatique du langage naturel, MUM repose sur une évolution du modèle Transformer, cette fois enrichie par le framework T5 (Text-To-Text Transfer Transformer). Ce dernier se distingue par une approche unifiée du traitement du langage : toutes les tâches (qu’il s’agisse de traduction, de résumé, de réponse à une question ou encore de classification) sont reformulées sous forme de texte. Cela signifie que l’entrée est toujours un texte, et la sortie également, ce qui permet à l’algorithme de traiter un grand nombre de missions dans un même format standardisé, avec un niveau de compréhension contextuelle beaucoup plus élevé. Là où BERT interprétait des requêtes, MUM les comprend, les interprète, les analyse et les anticipe. MUM est également capable de traduire une requête, de reformuler une réponse, de générer du texte, de résumer un contenu, ou encore d’établir des liens entre des informations issues de contextes différents. Cette capacité à exécuter plusieurs tâches en simultané (d’où l’adjectif multitâche) fait de MUM une technologie d’une puissance inédite. À titre de comparaison, MUM est considéré comme étant 1 000 fois plus performant que BERT, tant en rapidité de traitement qu’en qualité de compréhension, selon les ingénieurs de Google.

Le caractère multitâche de MUM lui permet également de traiter des requêtes complexes de manière plus humaine. Prenons l’exemple d’un utilisateur qui taperait la question suivante : « J’ai aimé Paris et Prague, mais pas Berlin. Quelle capitale européenne pourrait me plaire ? » Aujourd’hui, aucun moteur de recherche ne sait vraiment interpréter cette demande. Elle exige de comprendre des préférences implicites (peut-être un goût pour l’architecture romantique, les ambiances historiques ou les villes à taille humaine), d’exclure certaines options, et de croiser ces critères avec d’autres villes possibles. MUM, grâce à sa compréhension du langage naturel, sa mémoire contextuelle et sa capacité à raisonner sur des contenus variés, peut apporter une réponse pertinente, construite, et même proposer des suggestions personnalisées, à l’image d’un véritable conseiller en voyage. En d’autres termes, MUM incarne une nouvelle étape dans l’évolution des moteurs de recherche : Celle où l’intelligence artificielle ne se limite plus à “chercher”, mais à comprendre pour mieux répondre. C’est aussi une avancée qui reflète l’évolution des usages : les internautes ne tapent plus des mots-clés, mais posent des questions, parfois complexes, parfois imprécises, mais toujours orientées par une intention. Et c’est précisément cette intention que MUM vise à décrypter, grâce à une intelligence artificielle véritablement multitâche, évolutive et adaptative.

Google MUM : Un algorithme multimodal, multilingue et ultra-connecté

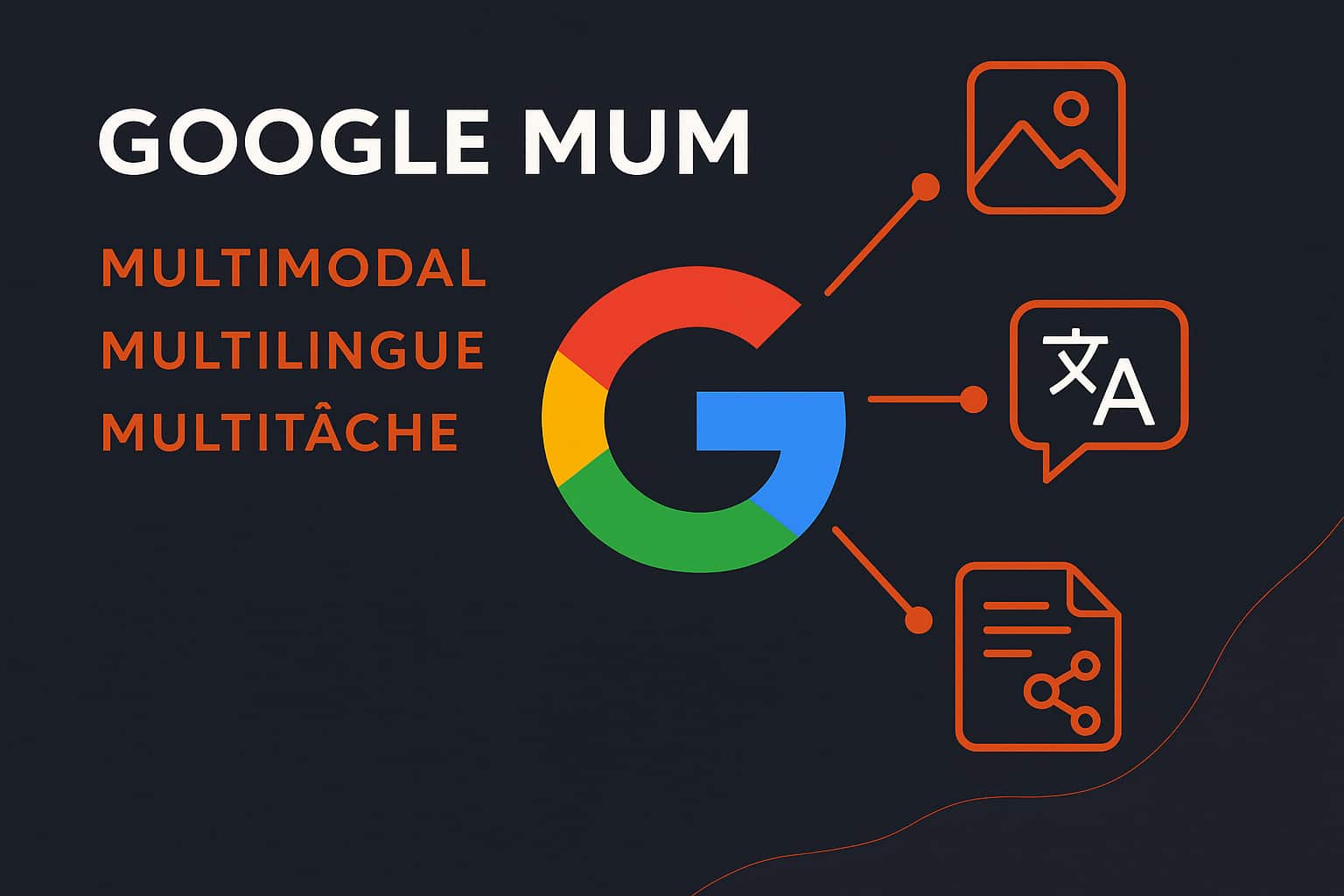

Avec MUM, Google franchit une étape décisive dans l’évolution de ses technologies d’intelligence artificielle. Si la puissance de traitement est impressionnante, c’est surtout dans ses capacités d’analyse et d’interprétation que ce nouvel algorithme se distingue. La véritable force de MUM réside dans sa triple compétence : il est à la fois multimodal, multilingue et multitâche. Ce triptyque technologique le positionne comme une IA particulièrement complète et agile, capable de traiter des requêtes complexes dans un monde numérique de plus en plus riche en formats, en langues et en contextes d’utilisation.

- Multimodal : Historiquement, les moteurs de recherche se concentraient sur les textes, parfois sur les images via des métadonnées, mais sans réelle compréhension du contenu visuel. Avec MUM, cette limite est en train de disparaître. L’algorithme est capable de croiser des informations issues de plusieurs types de contenus : texte, image, et à terme, vidéo et audio. Cela signifie qu’il peut interpréter une photo, la relier à une question, et en déduire une réponse pertinente. Par exemple, vous pouvez prendre une photo de vos chaussures de randonnée et demander : « Est-ce que ces chaussures conviennent pour gravir le Mont Fuji à l’automne ? ». MUM analyse à la fois l’image (type de semelle, matériaux, usure) et la question (contexte géographique, saison, difficulté de l’ascension), pour générer une réponse contextualisée et fiable. Cette approche multimodale ouvre la porte à des interactions beaucoup plus naturelles et intuitives avec le moteur de recherche ;

- Multilingue : L’accès à l’information reste inégal dans le monde en raison des barrières linguistiques. Jusqu’à présent, Google proposait des résultats principalement basés sur des contenus rédigés dans la langue de la requête. MUM change la donne. En étant formé sur 75 langues différentes, l’algorithme est capable de puiser dans des sources multilingues pour enrichir ses réponses, même si elles ne sont pas rédigées dans la langue d’origine de la recherche. Ainsi, une requête en français pourra s’appuyer sur un article de blog en japonais, une étude universitaire en anglais ou une vidéo explicative en allemand. Grâce à la traduction automatique intégrée et à sa compréhension des contenus contextuels, MUM peut restituer l’essence de ces sources dans la langue de l’utilisateur, de manière fluide et pertinente. Cette capacité étend considérablement la richesse des résultats accessibles et renforce la dimension universelle du web ;

- Multitâche : À la différence des anciens algorithmes qui exécutaient des tâches spécifiques (traduire, classer, extraire…), MUM peut effectuer plusieurs actions simultanément. Il sait traduire un texte, en extraire les informations clés, les résumer, détecter les intentions de l’utilisateur, reformuler les réponses, et même évaluer la pertinence ou la crédibilité des sources. Cette compétence multitâche repose sur l’architecture T5, qui permet de transformer chaque tâche en un exercice de génération de texte : l’entrée est un texte, et la sortie aussi. Ce fonctionnement standardisé permet à MUM de passer d’une tâche à l’autre sans rupture, avec une fluidité qui s’approche de la manière dont un humain traite l’information de façon holistique. Cela améliore considérablement la rapidité du traitement et la qualité des résultats retournés, tout en réduisant la charge cognitive pour l’utilisateur.

Cette combinaison technologique change radicalement la donne. Par exemple, si une ressource rare mais précieuse sur les conditions météorologiques du Mont Fuji est publiée uniquement en japonais, dans un format image extrait d’une infographie locale, MUM sera capable d’en extraire les données, de les traduire, de les interpréter dans le contexte de votre question, et de vous les restituer en français sous forme de réponse synthétique, compréhensible et contextualisée. C’est une avancée majeure qui rend la recherche non seulement plus intelligente, mais aussi véritablement mondiale, accessible et inclusive.

Ce niveau d’interconnexion entre formats, langues et tâches multiples marque l’entrée dans une nouvelle ère pour la recherche sur internet. Une ère où le moteur de recherche n’est plus simplement un outil de consultation, mais un assistant cognitif, capable de comprendre, d’agréger, de reformuler et de conseiller, quels que soient le support ou la langue des informations initiales.

Un impact évident sur le SEO et la stratégie de contenu

Bien que Google MUM soit encore en phase d’expérimentation, ses implications sur le référencement naturel (SEO) et la création de contenu commencent déjà à se dessiner avec clarté. Contrairement aux mises à jour classiques de l’algorithme, qui ajustaient principalement des critères de classement techniques ou pénalisaient certaines pratiques (comme Panda ou Penguin), MUM symbolise un changement beaucoup plus profond : il transforme le moteur de recherche en une entité capable de raisonner, de comprendre et de relier les informations comme le ferait un humain expert dans un domaine donné.

Ce basculement repose sur des fondations technologiques avancées issues du machine learning et du traitement du langage naturel (NLP). À la croisée des disciplines, MUM utilise des techniques telles que le transfer learning, la représentation vectorielle sémantique (embeddings), les transformers multi-encodés et le fine-tuning multitâche, pour traiter de manière simultanée une multitude de dimensions de la recherche : le sens, le contexte, la langue, la modalité du contenu, la structure narrative, l’intention utilisateur, et même la tonalité émotionnelle. Concrètement, cela signifie que Google n’évalue plus seulement un contenu sur des critères SEO classiques (présence de mots-clés, balises Hn, netlinking…), mais sur sa capacité à répondre à une intention de recherche complexe et contextualisée. Grâce à des techniques comme la désambiguïsation sémantique et les réseaux de neurones entraînés sur des corpus multilingues et multimodaux, MUM est capable d’associer une requête à un univers sémantique large, y compris si celle-ci est mal formulée, incomplète ou vague.

Par exemple, si un internaute recherche « Comment s’habiller pour une randonnée dans les Alpes en octobre ? », MUM va non seulement identifier le mot-clé principal (« s’habiller »), mais aussi contextualiser les termes comme « randonnée », « Alpes », « octobre » pour construire une compréhension complète des besoins : météo locale, altitudes, conditions typiques à cette saison, types de vêtements adaptés, etc. Il ira chercher ces informations dans des documents variés (articles, images, tableaux comparatifs, vidéos de blogs outdoor), quelle que soit leur langue d’origine, puis les synthétisera pour proposer une réponse pertinente. Pour les prestataires du SEO, cette évolution appelle à une révision en profondeur des méthodes traditionnelles. Voici les leviers clés à considérer :

- Le contenu utile et informatif : Les contenus doivent aller au-delà des simples mots-clés pour apporter une valeur ajoutée réelle. Cela implique de répondre aux questions sous-jacentes, d’explorer les sujets connexes, d’anticiper les besoins liés à une requête donnée. L’approche « FAQ + article de fond + ressources multimédia » devient ici une stratégie gagnante.

- Le champ sémantique : Travailler sur la richesse sémantique du contenu est désormais indispensable. Cela inclut l’usage de synonymes, cooccurrences, reformulations, expressions courantes, jargons sectoriels… Tout ce qui peut aider MUM à créer des correspondances vectorielles fines entre une requête complexe et votre contenu.

- La qualité multimédia : Les contenus non textuels prennent une importance croissante. Google étant désormais capable d’indexer, comprendre et relier les images, les vidéos et même l’audio à une intention de recherche, il devient essentiel d’optimiser ces formats : nommage des fichiers, attributs ALT, descriptions riches, transcriptions, balisages structurés (schema.org), etc.

- L’internationalisation : MUM est formé sur 75 langues et peut croiser des données d’une langue à l’autre pour enrichir ses réponses. Il est donc judicieux de penser son contenu dans une logique multilingue, que ce soit par la traduction optimisée de pages clés, l’adaptation culturelle des contenus, ou l’exploitation de données issues de sources internationales.

- La recherche vocale : Avec l’essor des assistants vocaux et des requêtes formulées en langage naturel, il devient crucial d’optimiser ses contenus pour répondre à des questions orales. Cela signifie privilégier un ton conversationnel, structurer les réponses comme dans une discussion (avec des phrases complètes, une syntaxe fluide), et intégrer des questions-réponses directement dans les textes.

Mais au-delà de ces optimisations, MUM pousse à adopter une approche beaucoup plus centrée sur l’utilisateur. Il ne s’agit plus de « positionner une page », mais de servir une intention. Et cette intention peut être multiple, floue, ou évolutive au cours d’une session de recherche. MUM intègre cette dimension temporelle et contextuelle, grâce à une mémoire sémantique qui relie les différents points d’une recherche à étapes multiples (recherche exploratoire).

Enfin, d’un point de vue algorithmique, MUM participe à une évolution vers des modèles plus explicatifs et plus génératifs. En plus de classer les contenus existants, il est capable de générer du texte, de formuler des réponses synthétiques ou de suggérer des sous-thèmes à explorer. Cela signifie que, dans certains cas, Google deviendra un concurrent direct des créateurs de contenus en produisant lui-même des résumés ou réponses à haute valeur ajoutée.

0 commentaires