Le Web est un formidable espace d’échange, de partage et d’expression. On y trouve des communautés solidaires, des débats enrichissants, des contenus inspirants. Mais cet espace, aussi vaste qu’anonyme, est également le terrain de jeu d’une autre réalité : celle des haters, ou haineux du Web que l’on retrouve évidemment aussi sur chaque réseau social. Ces utilisateurs, souvent invisibles derrière un pseudonyme ou un avatar, se manifestent par des propos hostiles, moqueurs, parfois violents, et répandent une atmosphère de rejet, de provocation ou de harcèlement. Mais qui sont ces haters, d’où vient ce comportement, et surtout comment s’en prémunir ? Pour mieux comprendre ce phénomène numérique devenu courant, il est essentiel d’en cerner les origines, les mécanismes et les impacts aussi bien sur les individus que sur les communautés en ligne.

la naissance et la typologie des haters sur internet

Le terme « hater », tiré de l’anglais « to hate » (détester), s’est imposé progressivement dans le langage courant à partir des années 2000 avec la montée en puissance des réseaux sociaux. Il désigne aujourd’hui un internaute qui exprime, de manière répétée et souvent agressive, une hostilité envers des personnes, des groupes, des idées ou des contenus diffusés en ligne. Ce comportement ne relève pas d’un simple désaccord ou d’une critique argumentée : il s’agit le plus souvent d’une démarche de rejet systématique, d’attaque ad hominem ou de dénigrement gratuit, avec pour seul objectif de blesser, rabaisser ou provoquer. Pour comprendre l’émergence des haters sur Internet, il faut remonter aux débuts du Web communautaire. Dès la fin des années 1990, des plateformes comme Usenet ou Slashdot ont vu apparaître des comportements de trolling, souvent moqueurs ou provocateurs, dans des forums spécialisés. À l’époque, ces formes de communication étaient marginales et restaient confinées à des cercles d’initiés, technophiles ou activement engagés dans la culture geek.

Mais c’est à partir de l’essor des réseaux sociaux ouverts que le phénomène prend une autre dimension. En 2004, Facebook naît à Harvard et s’ouvre au grand public en 2006. Twitter est lancé en 2006, YouTube en 2005, Instagram en 2010. Ces plateformes permettent aux utilisateurs de commenter publiquement, de partager massivement, et de s’adresser à une large audience, souvent sans filtre ni modération. L’anonymat partiel, la viralité et la gratification immédiate offerte par les likes ou les retweets renforcent l’attrait de comportements polarisants. Le hater devient une figure numérique récurrente. Le phénomène s’intensifie avec la montée des commentaires instantanés, des live streams, des stories et des vidéos courtes, qui exposent davantage les créateurs à la critique publique. La culture du clash et de la confrontation, alimentée par des formats courts et sensationnalistes, crée un climat favorable à l’expression d’avis extrêmes, parfois haineux.

Parallèlement, l’explosion des plateformes comme Reddit, 4chan, ou plus tard Discord, offre des espaces où des communautés entières peuvent se former autour de l’hostilité, de la dérision ou de l’exclusion. Le cas de 4chan, créé en 2003, est emblématique : plateforme de partage d’images sans inscription, elle a été l’un des berceaux de nombreux mouvements en ligne, certains bienveillants, d’autres beaucoup plus toxiques. C’est aussi sur ce type de plateforme que sont apparues les premières formes coordonnées de cyberharcèlement collectif.

Les haters se distinguent désormais en plusieurs catégories, qui ne se confondent pas toutes mais partagent un socle commun : l’agressivité verbale, la dévalorisation d’autrui, et l’absence de dialogue sincère.

- Le troll provocateur : Figure historique d’Internet, il ne croit pas forcément à ce qu’il écrit mais cherche à susciter des réactions, parfois pour se divertir, parfois pour nuire. Il manie l’ironie, la satire, ou l’absurde pour semer le chaos dans les discussions. Son terrain privilégié : les sections de commentaires et les forums publics ;

- Le frustré agressif : Il utilise le Web pour canaliser un mal-être personnel. Ses messages sont souvent empreints de jalousie, d’amertume ou de ressentiment envers des figures visibles (influenceurs, personnalités politiques, artistes…). Il prend pour cible ce qu’il perçoit comme une réussite injustifiée ;

- Le moraliste destructeur : Il se présente comme un défenseur de principes ou de valeurs mais use de la violence verbale pour disqualifier ceux qui pensent ou agissent différemment. Il instrumentalise la justice sociale, le militantisme ou la morale pour attaquer, sans ouverture au débat ;

- Le hater de groupe : Très actif dans les phénomènes de meute, il participe à des campagnes coordonnées d’humiliation, de harcèlement ou de dénigrement. On retrouve ce comportement dans certains mouvements extrémistes, groupuscules radicaux ou cercles fermés organisés sur des plateformes de messagerie.

Dans tous les cas, ce qui distingue le hater d’un utilisateur engagé ou critique, c’est l’absence d’intention constructive. Il ne cherche ni à échanger, ni à argumenter, mais à affirmer une supériorité symbolique en déstabilisant son interlocuteur, souvent dans le but de s’attirer de l’attention ou de renforcer un ego fragilisé. La technologie numérique, en facilitant l’anonymat et l’amplification, lui offre une scène sans précédent. On constate également une évolution géographique et sociologique du phénomène. Si les premiers haters étaient principalement issus des milieux technophiles occidentaux, leur profil s’est diversifié à mesure que l’accès à Internet s’est démocratisé. Aujourd’hui, on trouve des comportements haineux dans toutes les régions du monde, sur tous les continents, et dans toutes les langues. Le phénomène n’épargne aucun secteur : politique, mode, jeux vidéo, éducation, santé, sport…

En réponse à cette prolifération, de nombreux outils de modération ont vu le jour à partir des années 2010, portés par les grandes plateformes elles-mêmes ou par des développeurs tiers. Des politiques de signalement renforcées, des intelligences artificielles de détection de discours haineux, et des initiatives comme le « Trust and Safety Council » de Twitter (créé en 2016) témoignent d’une prise de conscience progressive.

Mais malgré ces efforts, les haters demeurent une réalité quotidienne sur Internet. Leur forme évolue, leurs cibles changent, mais leur logique demeure : imposer leur présence par le rejet, souvent au détriment du respect, du dialogue et de la diversité des opinions.

Les effets des discours haineux sur les individus et les communautés

Les discours haineux sur Internet ne sont jamais anodins. Même lorsqu’ils sont véhiculés derrière un écran, via un commentaire ou un message privé, ils produisent des impacts bien réels. Loin d’être de simples « mots en l’air », ces expressions de violence verbale ont des conséquences psychologiques, sociales et culturelles qui peuvent profondément affecter les personnes et les environnements numériques dans leur ensemble. Pour les individus directement visés (qu’il s’agisse d’un utilisateur lambda, d’un influenceur, d’un journaliste, ou d’un entrepreneur du Web) l’exposition répétée à la haine peut avoir des effets durables. Le harcèlement en ligne, même ponctuel, peut s’inscrire dans la mémoire émotionnelle comme un traumatisme. Lorsqu’il est soutenu ou organisé, il peut aller jusqu’à engendrer des troubles mentaux ou sociaux majeurs, avec des répercussions sur la vie personnelle et professionnelle.

Mais les conséquences dépassent les seules victimes directes. L’environnement numérique lui-même se dégrade lorsque les discours toxiques se multiplient : La peur de s’exprimer gagne du terrain, les débats deviennent stériles ou polarisés, et les utilisateurs modérés ou bienveillants désertent les plateformes, lassés par la violence ambiante. Voici, sous forme de tableau, les principaux effets des discours haineux, tant au niveau individuel que communautaire :

| Impact sur les individus | Impact sur les communautés |

|---|---|

| Stress et anxiété persistants Être ciblé par des commentaires agressifs peut générer une tension constante, une peur de publier ou même de consulter ses notifications. |

Climat de méfiance généralisée Les utilisateurs deviennent plus méfiants, moins enclins à interagir ou à s’ouvrir aux autres, ce qui appauvrit les échanges. |

| Perte de confiance en soi Les attaques personnelles ou humiliantes peuvent entamer l’estime de soi, surtout chez les jeunes ou les personnes déjà vulnérables. |

Diminution de la diversité d’opinion Les voix minoritaires ou divergentes se taisent pour éviter les représailles, conduisant à une uniformisation des points de vue. |

| Dépression et isolement Chez certaines victimes, la répétition des attaques mène à un retrait social, voire à des épisodes dépressifs ou des idées suicidaires. |

Polarisation des débats Les échanges deviennent binaires, extrêmes et conflictuels, ce qui décourage le dialogue constructif ou nuancé. |

| Auto-censure et retrait du Web Face à la haine, beaucoup choisissent de supprimer leurs publications, voire leurs comptes, coupant court à leur présence numérique. |

Départ des profils modérés Les utilisateurs désireux d’échanges paisibles quittent les plateformes, laissant place à des environnements plus radicaux. |

| Atteinte à la réputation professionnelle Un commentaire haineux ou diffamatoire peut nuire à la crédibilité ou à l’image publique d’un professionnel du numérique. |

Baisse de qualité des espaces de discussion Les forums, groupes ou fils de commentaires deviennent toxiques, stériles ou désertés. |

| Harcèlement coordonné ou doxing Dans les cas extrêmes, les haters vont jusqu’à diffuser les données personnelles de leurs cibles, provoquant des atteintes graves à la vie privée. |

Normalisation de la violence verbale Quand les discours haineux ne sont pas modérés, ils deviennent banalisés et acceptés, voire reproduits par d’autres internautes. |

Face à ces constats, il devient évident que les discours haineux en ligne ne peuvent être considérés comme de simples « opinions désagréables ». Ils participent à une dynamique d’exclusion, de peur et de repli qui mine à la fois la santé mentale des individus et la vitalité des espaces numériques.

Il incombe aux plateformes de prendre leurs responsabilités : modération active, outils de signalement accessibles, algorithmes plus sensibles aux comportements nocifs. Mais les utilisateurs eux-mêmes ont un rôle à jouer, en dénonçant la haine, en soutenant les victimes et en promouvant un Web plus respectueux et constructif.

Comment se protéger des haters et assainir les échanges en ligne

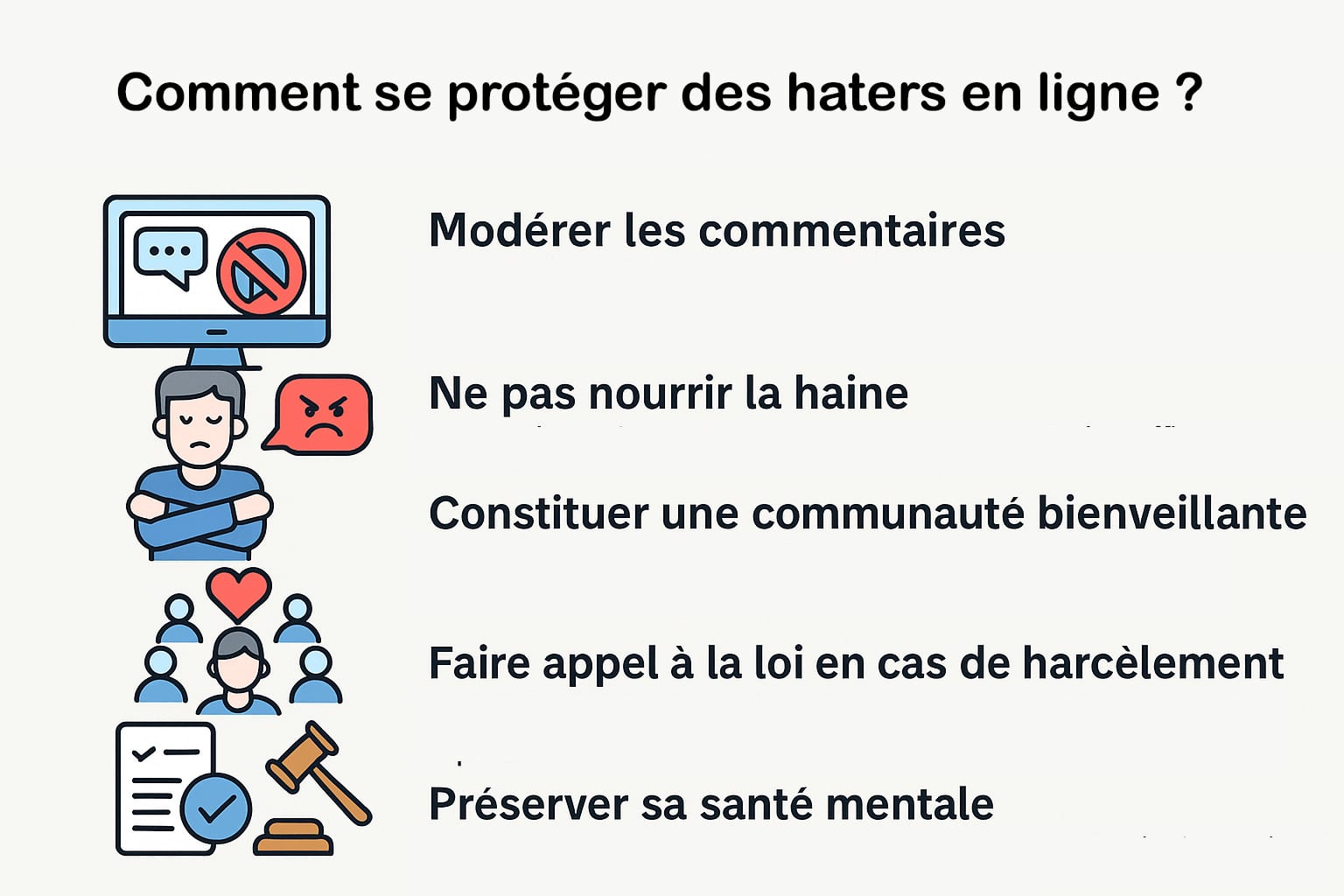

Avec la multiplication des interactions numériques et l’essor des réseaux sociaux, la présence des haters est devenue presque inévitable. Pour autant, cela ne signifie pas qu’il faille s’y résigner. Il existe de nombreux moyens d’atténuer leur influence, de se prémunir contre leurs attaques et de maintenir un climat sain dans les espaces d’échange. Que l’on soit un internaute occasionnel, un créateur de contenu suivi par des milliers de personnes, une entreprise ou un modérateur de communauté, il est essentiel de connaître les outils, les réflexes et les mécanismes de protection disponibles. Les stratégies de défense ne sont pas uniquement techniques (voir aussi notre sujet sur : Faut-il répondre aux trolls ? » : Elles relèvent aussi du comportement, de la psychologie, du droit et de la construction d’un environnement numérique plus éthique. Prévenir les discours haineux, c’est à la fois se protéger soi-même et œuvrer pour une culture Web plus respectueuse, où les échanges sont fondés sur le dialogue, la tolérance et l’intelligence collective. Voici un tableau synthétique des meilleures pratiques à adopter pour faire face aux haters et favoriser un climat d’échange constructif :

| Bonnes pratiques | Explication |

|---|---|

| Modérer les commentaires | Mettre en place une modération active est indispensable pour éviter que les espaces de discussion deviennent des déversoirs à haine. Utiliser des outils de filtrage automatique, approuver les commentaires avant publication, bloquer les mots-clés injurieux ou racistes et sanctionner les comportements récurrents permet de limiter la propagation des messages toxiques. Il est aussi utile de nommer des modérateurs humains qui sauront interpréter le contexte, notamment dans les groupes fermés ou les forums spécialisés. |

| Ne pas nourrir la haine | Engager une conversation avec un hater revient souvent à lui donner la visibilité et l’attention qu’il recherche. Il est donc préférable de ne pas répondre à la provocation. Ignorer ou supprimer les messages offensants évite d’alimenter le conflit et préserve votre énergie. Dans certains cas, la simple absence de réaction suffit à faire cesser les attaques. Cependant, il est utile de distinguer un utilisateur maladroit d’un vrai hater avant d’agir. |

| Constituer une communauté bienveillante | Une communauté fidèle, engagée et respectueuse agit comme un rempart contre les discours haineux. En valorisant les commentaires constructifs, en remerciant les contributions utiles et en incitant à la modération entre pairs, vous créez une dynamique collective qui décourage les comportements négatifs et soutient les personnes ciblées. Les modérateurs et membres actifs peuvent jouer un rôle de « gardiens de l’ambiance ». |

| Faire appel à la loi en cas de harcèlement | Les injures, menaces, diffamations ou publications portant atteinte à la vie privée peuvent relever du droit pénal. En cas de harcèlement répété, il est important de conserver les preuves (captures d’écran, liens, dates) et de porter plainte auprès des autorités compétentes. Des associations comme e-Enfance, Pharos ou Point de Contact peuvent accompagner les victimes dans leurs démarches. Certains avocats se sont spécialisés dans la cybercriminalité. |

| Préserver sa santé mentale | Être pris pour cible en ligne peut être extrêmement éprouvant. Il est important de reconnaître ses émotions, de s’accorder des temps de pause numérique et de parler de ce que l’on vit à des personnes de confiance. Prendre du recul, limiter son exposition aux commentaires ou désactiver temporairement les notifications peut aider à se recentrer sur l’essentiel. Des consultations avec un psychologue peuvent être utiles en cas de stress prolongé lié à la haine en ligne. |

| Utiliser les fonctions de blocage | La plupart des plateformes permettent de bloquer un utilisateur ou de masquer ses publications. Ces fonctions sont parfois sous-utilisées, alors qu’elles constituent un outil simple et efficace pour couper court à l’escalade de la haine. Bloquer n’est pas fuir : c’est se protéger. Certaines plateformes permettent aussi de restreindre un utilisateur sans qu’il en soit averti. |

| Éduquer et sensibiliser | Partagez des ressources sur le cyberharcèlement, animez des discussions autour de la bienveillance numérique, et encouragez une culture de l’écoute dans vos espaces en ligne. L’éducation aux usages numériques est la clé d’un Web plus sûr pour tous. Cela peut aussi passer par des chartes de bonne conduite, des rappels réguliers ou des actions collaboratives menées par la communauté elle-même. |

| Paramétrer sa confidentialité | Limiter l’accès à ses contenus personnels (photos, publications, stories) à un cercle restreint de contacts permet de réduire les risques d’exposition à la haine gratuite. De nombreuses plateformes offrent des options de visibilité granulaire : filtres par groupe, validation manuelle des abonnés, désactivation des commentaires par post, etc. |

| Utiliser des outils de signalement intelligents | Les réseaux sociaux mettent à disposition des systèmes de signalement pour comportements abusifs. Prendre le temps de les utiliser permet d’alerter les modérateurs de plateforme et d’initier des sanctions. De plus, des outils comme Block Party, Bodyguard ou CommentGuard permettent d’automatiser une partie de la gestion des interactions toxiques. |

| Se former aux codes du Web | Connaître les dynamiques propres aux réseaux sociaux, les mécanismes de viralité, et les typologies de haters permet d’anticiper certains comportements et de mieux y répondre. La culture numérique évolue rapidement, et rester informé(e) est un levier de résilience face aux discours haineux. |

| Encourager la prise de parole des alliés | Lorsque des membres de la communauté prennent la défense d’une personne attaquée, cela renverse le rapport de force. Inciter à cette solidarité numérique crée une dynamique positive qui isole les comportements haineux et soutient les victimes. |

Les plateformes elles-mêmes ont une responsabilité majeure. Depuis les années 2010, plusieurs d’entre elles (Facebook, Twitter, Instagram, YouTube…) ont renforcé leurs politiques contre la haine en ligne : suppression des comptes récidivistes, algorithmes de détection automatique, modération humaine renforcée, et intégration de messages d’avertissement ou d’appel à la réflexion avant publication de contenus potentiellement problématiques. Des initiatives institutionnelles voient aussi le jour : En France, la loi contre la haine en ligne (dite « loi Avia », discutée dès 2019) a tenté de renforcer la régulation, même si sa mise en œuvre reste complexe. À l’échelle européenne, le Digital Services Act, entré en vigueur progressivement depuis 2023, impose aux grandes plateformes des obligations de modération et de transparence accrues.

En fin de compte, lutter contre les haters, c’est une démarche collective. Il ne s’agit pas seulement de se défendre, mais aussi de protéger les autres, de défendre des espaces d’échange respectueux, et de faire du Web un lieu où chacun peut s’exprimer sans craindre d’être attaqué pour ce qu’il est, ce qu’il pense ou ce qu’il crée.

0 commentaires