À chaque pression sur une touche du clavier, un processus discret s’enclenche en arrière-plan. Ce qui apparaît comme une simple lettre ou un chiffre est immédiatement converti en une suite organisée de 0 et de 1. Les ordinateurs ne lisent ni mots ni phrases : ils interprètent exclusivement des signaux binaires. Cette traduction instantanée entre écriture humaine et logique machine repose sur une norme fondatrice de l’informatique moderne : L’ASCII. L’ASCII a permis d’uniformiser la représentation des caractères et d’assurer des échanges textuels fiables entre systèmes informatiques. En attribuant une valeur numérique spécifique à chaque symbole, il a instauré un langage commun compréhensible par toutes les machines compatibles. Explorer sa définition et son fonctionnement, c’est remonter aux bases mêmes de la communication numérique.

Qu’est-ce que l’encodage ASCII ? Origine, histoire & définition

L’ASCII, acronyme de American Standard Code for Information Interchange, est une norme de codage des caractères officiellement publiée en 1963 aux États-Unis. Elle est élaborée par l’American Standards Association (ASA), qui deviendra plus tard l’American National Standards Institute (ANSI). À cette époque, l’informatique est en pleine structuration : les ordinateurs occupent des salles entières et les communications numériques commencent à se développer, notamment via les télétypes et les premiers réseaux. Dans les années 1950 et au début des années 1960, chaque constructeur (comme IBM ou d’autres fabricants de systèmes informatiques) utilise son propre système de codage des caractères. Cette diversité complique fortement les échanges de données. Un texte produit sur une machine peut devenir illisible sur une autre. Il devient alors nécessaire de définir un standard commun pour permettre aux systèmes de dialoguer. C’est dans ce contexte que l’ASCII voit le jour. Son objectif est clair : Unifier la représentation des caractères textuels afin de faciliter l’échange d’informations entre différents équipements informatiques et systèmes de télécommunication. Inspiré notamment des codes utilisés en télégraphie, l’ASCII introduit un référentiel universel fondé sur une correspondance numérique stable.

La première version officielle paraît en 1963, puis une révision majeure intervient en 1967. Cette dernière fixe la structure définitive sur 7 bits et intègre les lettres minuscules, absentes de la toute première mouture. En 1968, l’ASCII est reconnu comme standard fédéral aux États-Unis, ce qui accélère son adoption dans les administrations, les universités et l’industrie technologique. Le principe de l’ASCII repose sur une table de correspondance simple et structurée. Chaque caractère (lettre, chiffre, symbole ou commande technique) est associé à un nombre compris entre 0 et 127. Cette plage correspond à un encodage sur 7 bits, permettant de représenter 27, soit 128 combinaisons distinctes. La table ASCII comprend :

- Les lettres majuscules (A à Z) ;

- Les lettres minuscules (a à z) ;

- Les chiffres (0 à 9) ;

- Les signes de ponctuation ;

- Les symboles mathématiques de base ;

- Les caractères de contrôle (retour à la ligne, tabulation, fin de transmission, etc.).

Les 32 premiers codes (de 0 à 31) sont réservés aux caractères de contrôle. Ils sont hérités des systèmes de télécommunication et des télétypes, et servent à piloter l’affichage ou la transmission des données. Le code 127 correspond quant à lui au caractère “DEL”, utilisé historiquement pour la suppression. À titre d’exemple :

- La lettre “A” correspond au nombre décimal 65

- La lettre “a” correspond au nombre décimal 97

- Le chiffre “0” correspond au nombre décimal 48

Ces valeurs numériques sont ensuite converties en binaire afin d’être interprétées par l’ordinateur. Ainsi, 65 devient 1000001 sur 7 bits. Cette représentation binaire constitue le langage fondamental des circuits électroniques. Dans les années 1970 et 1980, avec l’essor des micro-ordinateurs et des réseaux, l’ASCII s’impose comme une base technique incontournable. Toutefois, son encodage limité à 128 caractères pose rapidement problème pour les langues comportant des accents ou des alphabets spécifiques. Des variantes dites “ASCII étendu” apparaissent alors, utilisant 8 bits (soit 256 combinaisons). Ces extensions, comme ISO 8859-1 en Europe, tentent d’intégrer des caractères supplémentaires, mais sans uniformité mondiale.

Cette évolution mènera, dans les années 1990, à la création d’Unicode, un standard capable de représenter l’ensemble des systèmes d’écriture mondiaux. Malgré cette transition, l’ASCII demeure le socle historique de l’encodage des caractères. Les 128 premiers caractères d’Unicode et du format UTF-8 correspondent toujours exactement à la table ASCII définie dans les années 1960. Ainsi, l’ASCII n’est pas seulement une table de correspondance technique : il représente une étape fondatrice dans l’histoire de la normalisation informatique. Il a posé les bases d’une communication numérique structurée, interopérable et durable, dont les principes continuent de façonner les technologies actuelles.

Comment fonctionne l’encodage ASCII ? Tableaux d’exemples

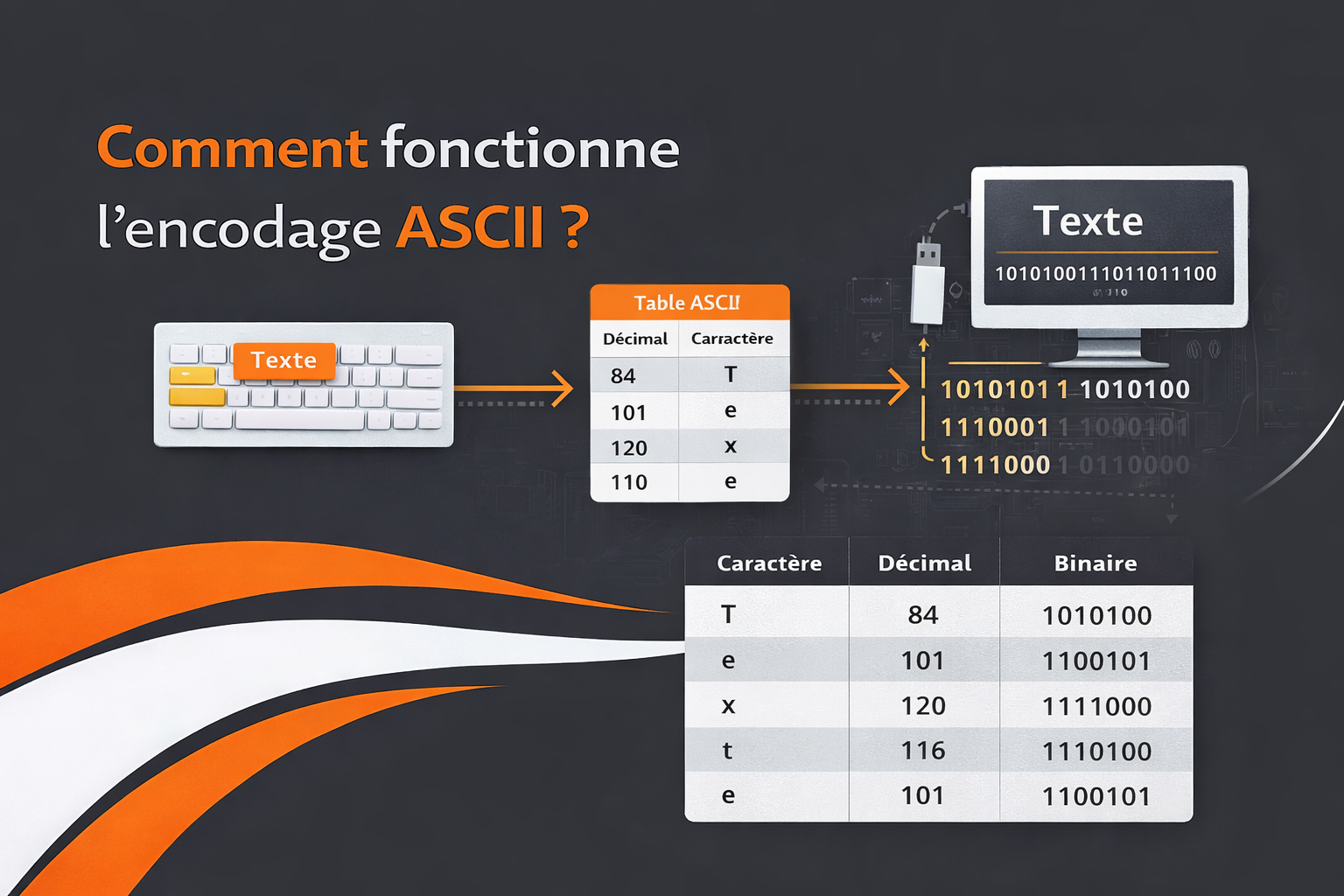

Le fonctionnement de l’encodage ASCII repose sur un mécanisme méthodique : chaque caractère saisi est converti en une valeur numérique, elle-même traduite en binaire afin d’être comprise par la machine. L’ordinateur ne manipule jamais directement des lettres ou des symboles ; il traite exclusivement des nombres représentés sous forme de bits. Concrètement, lorsqu’un utilisateur tape un texte au clavier, le système consulte la table ASCII pour associer à chaque caractère son équivalent décimal. Cette valeur est ensuite convertie en binaire sur 7 bits (dans la version standard). Le processus inverse s’effectue lors de l’affichage : la machine lit la valeur binaire, la transforme en nombre décimal, puis retrouve le caractère correspondant. Prenons un premier exemple simple avec le mot “Hi” :

| Caractère | Valeur décimale | Valeur binaire (7 bits) |

|---|---|---|

| H | 72 | 1001000 |

| i | 105 | 1101001 |

Ces deux séquences binaires sont stockées en mémoire ou transmises sur un réseau. Lors de la restitution à l’écran, le système interprète 1001000 comme 72, puis affiche “H”, et ainsi de suite. Observons maintenant un exemple plus complet avec un mot courant :

| Caractère | Décimal | Binaire |

|---|---|---|

| T | 84 | 1010100 |

| e | 101 | 1100101 |

| x | 120 | 1111000 |

| t | 116 | 1110100 |

| e | 101 | 1100101 |

Chaque lettre du mot “Texte” est encodée individuellement. L’ordinateur ne perçoit jamais le mot comme une unité globale, mais comme une succession ordonnée de codes numériques. Les chiffres et symboles suivent la même logique :

| Caractère | Décimal | Binaire |

|---|---|---|

| 0 | 48 | 0110000 |

| 5 | 53 | 0110101 |

| ? | 63 | 0111111 |

| @ | 64 | 1000000 |

| # | 35 | 0100011 |

On remarque que les chiffres sont regroupés dans une plage continue (48 à 57), ce qui facilite leur manipulation en programmation informatique. De la même manière, les lettres majuscules (65 à 90) et minuscules (97 à 122) sont organisées de façon séquentielle. Voici un extrait synthétique de ces plages :

| Type de caractères | Plage décimale |

|---|---|

| Caractères de contrôle | 0 à 31 |

| Chiffres (0–9) | 48 à 57 |

| Lettres majuscules (A–Z) | 65 à 90 |

| Lettres minuscules (a–z) | 97 à 122 |

Un autre aspect fondamental concerne les caractères de contrôle. Comme évoqué plus haut, les 32 premières positions de la table ASCII ne sont pas destinées à l’affichage, mais à la gestion technique des flux de données. Ils proviennent des systèmes de télécommunication et des télétypes.

| Nom | Abréviation | Code décimal | Fonction |

|---|---|---|---|

| Null | NUL | 0 | Valeur nulle |

| Tabulation | TAB | 9 | Insertion d’une tabulation |

| Line Feed | LF | 10 | Saut de ligne |

| Carriage Return | CR | 13 | Retour chariot |

| Escape | ESC | 27 | Commande d’échappement |

Ces caractères jouent encore aujourd’hui un rôle important. Par exemple, sous les systèmes Unix, un saut de ligne correspond uniquement au code LF (10), tandis que les systèmes Windows combinent CR (13) et LF (10). Sur le plan technique, l’ASCII standard utilise 7 bits. Toutefois, les ordinateurs modernes fonctionnent sur des architectures basées sur des octets de 8 bits. Cela a conduit à l’ajout d’un bit supplémentaire, ouvrant la voie à l’ASCII étendu.

| Type d’encodage | Nombre de bits | Nombre de combinaisons |

|---|---|---|

| ASCII standard | 7 bits | 128 caractères |

| ASCII étendu | 8 bits | 256 caractères |

L’ASCII étendu permet d’intégrer des caractères supplémentaires, notamment des lettres accentuées ou des symboles graphiques. Par exemple :

| Caractère | Décimal (8 bits) |

|---|---|

| é | 233 |

| ç | 231 |

| à | 224 |

Cependant, ces valeurs pouvaient varier selon les standards régionaux (comme ISO 8859-1), ce qui limitait l’interopérabilité internationale.

Quelles sont les limites et l’évolution de l’encodage ASCII ?

L’encodage ASCII a joué un rôle fondateur dans l’histoire du numérique, mais il est intrinsèquement lié aux contraintes techniques des débuts de l’informatique, ce qui est moins le cas pour des solutions comme les inventions de type Markdown par exemple Conçu sur une structure de 7 bits, ASCII permet de représenter 128 caractères distincts. Ce choix était cohérent à une époque où la mémoire coûtait cher, où les transmissions de données étaient lentes et où l’objectif principal consistait à standardiser les échanges en langue anglaise. Toutefois, cette capacité limitée s’est rapidement heurtée à la réalité d’un monde linguistiquement riche et technologiquement en pleine expansion. La première limite concerne la couverture linguistique. Les 128 caractères disponibles incluent les lettres latines non accentuées, les chiffres, les symboles de ponctuation et des caractères de contrôle. En revanche, les lettres accentuées comme “é”, “à”, “ç”, “ñ” ou “ö” sont absentes de la table standard. Cette restriction rend l’ASCII inadapté à la rédaction correcte de nombreuses langues européennes, sans parler des alphabets grec, cyrillique, arabe, hébreu ou des systèmes d’écriture asiatiques.

Pour pallier cette insuffisance, des extensions sur 8 bits ont été introduites dans les années 1970 et 1980. En exploitant un octet complet (soit 256 combinaisons), ces variantes permettaient d’ajouter des caractères supplémentaires. Cependant, ces solutions n’étaient pas universelles. Chaque région ou constructeur adoptait sa propre table d’encodage, créant de nouvelles incompatibilités. Un texte correctement affiché sur un système pouvait apparaître corrompu sur un autre, simplement parce que les valeurs supérieures à 127 n’étaient pas interprétées de la même manière. Cette fragmentation a mis en évidence la nécessité d’un standard global capable de représenter l’ensemble des systèmes d’écriture mondiaux dans une seule structure cohérente. C’est dans ce contexte qu’est né Unicode, avec l’ambition d’attribuer un identifiant unique à chaque caractère, indépendamment de la plateforme, du logiciel ou de la langue. Contrairement à l’ASCII, limité à 128 entrées, Unicode prévoit un espace de codage suffisamment vaste pour couvrir des dizaines de milliers de caractères.

L’un des tournants majeurs a été l’adoption de formats d’encodage compatibles avec l’héritage existant. Les premiers 128 caractères d’Unicode correspondent exactement à ceux de l’ASCII, garantissant une compatibilité ascendante. Cela signifie qu’un texte composé uniquement de caractères ASCII reste parfaitement valide dans les systèmes modernes basés sur Unicode. Cette continuité a permis une transition progressive sans rupture technologique brutale. Avec la généralisation du web, des bases de données et des applications internationales, les exigences ont encore évolué. Il ne s’agissait plus seulement de représenter des alphabets variés, mais aussi des symboles monétaires, des caractères scientifiques, des pictogrammes et, plus récemment, des émojis. Dans cet environnement globalisé, des encodages avancés comme utf8mb4 ont été adoptés afin de prendre en charge l’ensemble des caractères Unicode, y compris ceux nécessitant quatre octets. Malgré ces évolutions majeures, l’ASCII conserve une présence structurante dans les systèmes actuels. Les protocoles fondamentaux d’internet reposent historiquement sur des échanges textuels basés sur ses caractères d’origine. Les langages de programmation comme Perl (par exemple) utilisent exclusivement des symboles issus de la table ASCII pour définir la syntaxe : Accolades, parenthèses, opérateurs ou points-virgules. Même dans les environnements entièrement compatibles Unicode, les bases syntaxiques demeurent héritées de cette norme initiale.

L’ASCII reste également central dans les fichiers texte simples, les scripts système, les journaux techniques et de nombreux formats de configuration. Sa simplicité contribue à sa robustesse : Un texte limité aux 128 caractères standards peut être lu sans ambiguïté sur pratiquement tous les systèmes existants. Au-delà de la technique, l’ASCII a même influencé des pratiques culturelles et artistiques. L’art ASCII, par exemple, détourne les caractères textuels pour produire des représentations visuelles. Cette appropriation créative témoigne de la longévité et de la polyvalence d’un standard initialement conçu pour la transmission de données.

Ainsi donc pour conclure, les limites structurelles de l’ASCII ont stimulé l’innovation et favorisé l’émergence de standards plus inclusifs et universels. Pourtant, loin d’avoir disparu, il demeure le socle conceptuel sur lequel reposent les encodages contemporains. Son héritage technique continue d’imprégner l’architecture des systèmes numériques modernes, preuve qu’un standard pensé pour les contraintes d’hier peut encore influencer durablement les technologies d’aujourd’hui.

0 commentaires